Viele Probleme beim Arbeiten mit Sprachmodellen entstehen nicht durch das Modell, sondern durch eine falsche Erwartung: Wir setzen voraus, dass die KI unsere unausgesprochene Intention versteht, obwohl sie keinen Referenzrahmen dafür hat. LLMs erkennen und verlängern Muster – ohne ein klares Muster im Prompt leidet die Qualität der Ausgabe spürbar. Few Shot Prompting setzt genau da an: Statt das Modell nur anzuweisen, was es tun soll, zeigst du ihm, wie eine gute Antwort aussieht.

Was ist Few Shot Prompting?

Few Shot Prompting ist eine Methode im Prompt Engineering, bei der dem Sprachmodell (LLM) innerhalb der Eingabeaufforderung (Prompt) mehrere Beispiele – sogenannte „Shots“ – präsentiert werden. Diese Beispiele demonstrieren die gewünschte Aufgabe und geben dem Modell ein klares Muster für den erwarteten Output vor.

Im Bereich NLP (Natural Language Processing) verbindet diese Technik das allgemeine Wissen des Modells mit der konkreten Anforderung. Statt nur eine Aufgabe zu beschreiben, lieferst du den Kontext direkt mit. Die Frage „Was ist ein Few-Shot?“ lässt sich technisch präzise beantworten: Es ist ein Datensatz aus Input und idealem Output, der dem Modell als temporäre Referenz dient.

Few Shot Prompting gehört zum Bereich des In-Context Learning. Das Modell lernt für die Dauer der Session aus den gegebenen Beispielen, ohne dass sich seine internen Parameter ändern – es wird also nicht neu trainiert, sondern anders ausgerichtet.

Für eine tiefere Einordnung der Begrifflichkeiten lohnt sich ein Blick in die Grundlagen des Prompt Engineering sowie die Basis-Definition eines Prompts.

Wie funktioniert Few Shot Prompting?

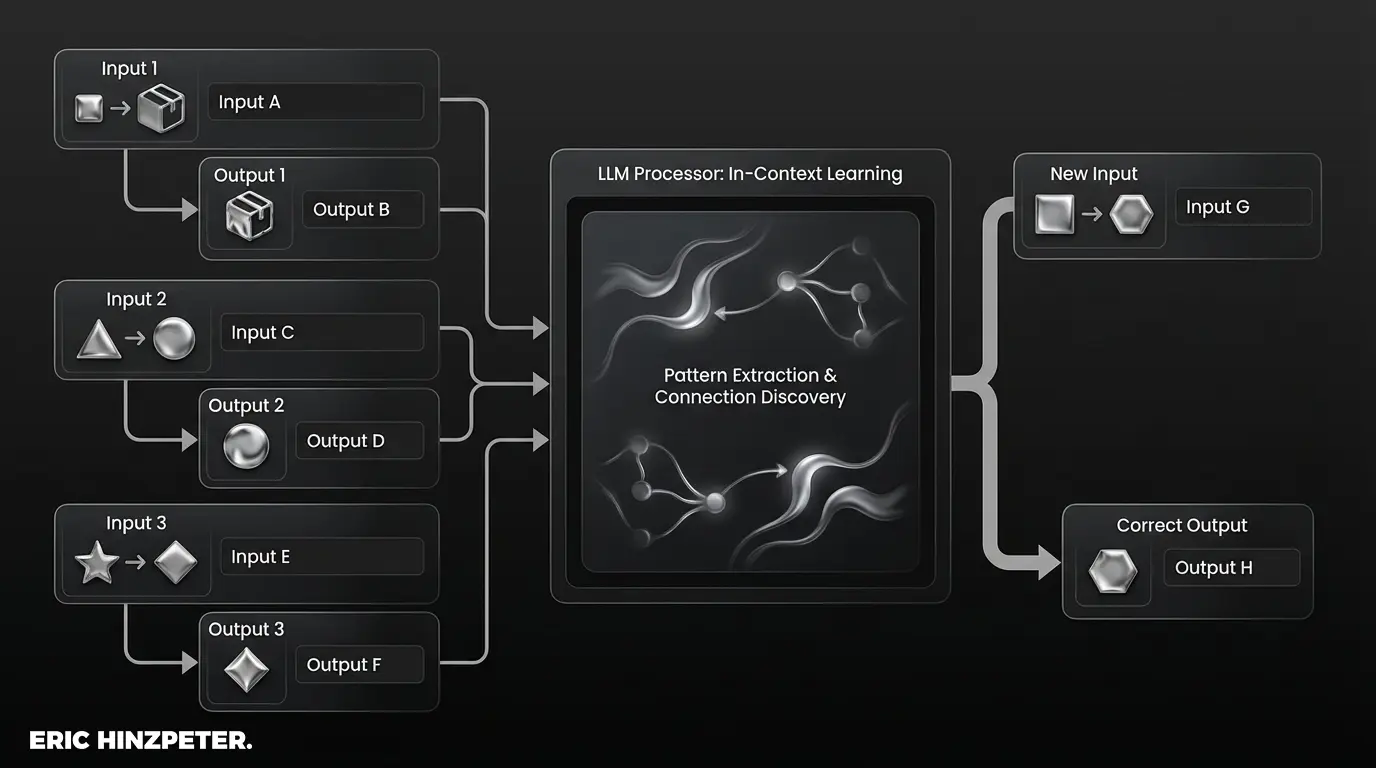

Die Grundlage ist die fundamentale Eigenschaft von Sprachmodellen: Mustererkennung. Large Language Models (LLMs) wie GPT-5.4 sind darauf trainiert, Wahrscheinlichkeiten für das nächste Wort in einer Sequenz vorherzusagen. Wenn ein Prompt eine Reihe von Beispielen enthält (z.B. „Frage: A, Antwort: B“), erkennt das Modell die logische Struktur zwischen Input und Output.

Dieses Phänomen wird als In-Context Learning bezeichnet. Das Modell analysiert die semantischen und syntaktischen Beziehungen in den bereitgestellten Beispielen und wendet das erkannte Muster auf die neue Aufgabe an. Es findet keine Anpassung der Modellgewichte statt (kein Training im klassischen Sinne), sondern eine temporäre Ausrichtung des Aufmerksamkeitsfokus auf das demonstrierte Schema.

Größere Sprachmodelle profitieren besonders von dieser Methodik, da ihre Kapazität zur Mustererkennung über längere Textsequenzen hinweg stärker ausgeprägt ist. Je klarer das Muster im In-Context Learning definiert ist, desto präziser folgt das Large Language Model der Vorgabe.

Ein tieferes Verständnis der technischen Limitierungen, wie etwa der Verarbeitungskapazität, bietet der Artikel zu Token und LLMs.

Unterschiede: Zero-Shot, One-Shot und Few-Shot

Der Aufbau des Prompts hat direkte Auswirkung auf die Antwortqualität. Drei Stufen sind dabei relevant:

- Zero-Shot Prompting: Kein Beispiel, nur die Aufgabe. Das Modell verlässt sich ausschließlich auf sein vortrainiertes Wissen.

Beispiel: „Klassifiziere diesen Text.“ - One-Shot Prompting: Ein Beispiel, das Format und Struktur festlegt.

Beispiel: „Klassifiziere wie folgt: ‚Toller Service‘ → Positiv. Klassifiziere nun: ‚Lange Wartezeit‘.“ - Few-Shot Prompting: Mehrere Beispiele (meist 2 bis 5), notwendig wenn Nuancen unterschieden oder komplexe Formate eingehalten werden müssen.

Der Unterschied zwischen Zero und Few Shot liegt in der Führung. Während Zero-Shot Prompting auf die allgemeine Intelligenz des Modells setzt, zwingt Few-Shot das Modell in ein spezifisches Korsett aus Logik und Format. Wer tiefer in die methodische Abgrenzung einsteigen möchte, findet im Artikel zu Zero-Shot Prompting weitere Details.

Pro-Tipp: Skalierung der Beispiele

Fang immer mit Zero-Shot an, um die Baseline zu testen. Wenn das Ergebnis zu generisch ist, füge nicht sofort fünf Beispiele hinzu. Starte mit einem (One-Shot), um das Format zu fixieren. Erst wenn inhaltliche Nuancen fehlen, macht Few-Shot mit 3–5 Beispielen Sinn.

Vorteile von Few Shot Prompting bei LLMs

Der größte praktische Vorteil von Few Shot Prompting bei LLMs ist die Output-Qualität. Durch die Vorgabe von Beispielen sinkt die Wahrscheinlichkeit von Halluzinationen, da das Modell in einem definierten Lösungsraum arbeitet.

Ein weiterer Aspekt ist die Formattreue. Besonders bei der Generierung strukturierter Daten (JSON, CSV, Listen) stellt Few-Shot sicher, dass Syntax und Schema eingehalten werden. Das steigert die Effizienz in automatisierten Workflows erheblich, weil weniger Post-Processing nötig ist.

Zudem lassen sich damit komplexe Aufgaben ohne aufwendiges Nachtraining (Fine-Tuning) lösen. Leistungsstarke Modelle wie GPT-5.4 lösen damit Aufgaben, die früher spezialisierten Algorithmen vorbehalten waren. Ändert sich die Anforderung, müssen lediglich die Beispiele im Prompt ausgetauscht werden, nicht das gesamte System.

Praktische Beispiele für Few Shot Prompts

Entscheidend bei Few Shot Prompts ist die klare Trennung von Input und Output in jedem Beispiel. Die folgenden Anwendungsfälle zeigen, wie das in der Praxis aussieht.

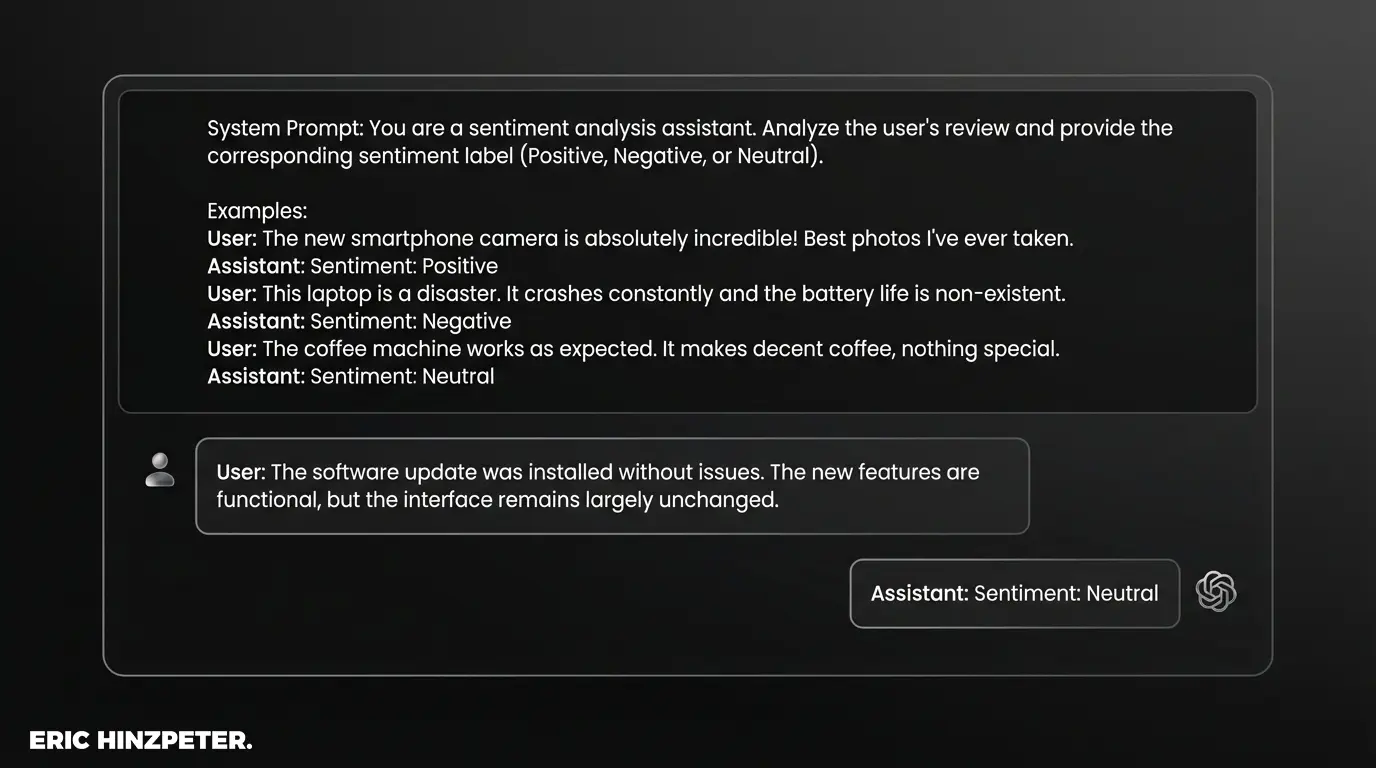

Anwendungsfall 1: Sentiment Analyse

Hier soll das Modell lernen, nicht nur positiv/negativ zu unterscheiden, sondern auch Nuancen wie „Neutral“ oder „Gemischt“ zu erkennen.

Aufgabe: Klassifiziere die Kundenbewertungen in Positiv, Negativ oder Neutral. Review: "Der Versand war schnell, aber das Produkt ist beschädigt." Sentiment: Negativ Review: "Ganz okay für den Preis, erfüllt seinen Zweck." Sentiment: Neutral Review: "Besser als erwartet! Werde ich wieder kaufen." Sentiment: Positiv Review: "Der Support hat mir sofort geholfen, danke." Sentiment: [KI generiert hier: Positiv]

Anwendungsfall 2: Strukturierte Textgenerierung

Für die Textgenerierung im Marketing ist Konsistenz entscheidend. Hier zwingen wir das Modell in ein Format für Produktbeschreibungen.

Wandel die Produkt-Features in einen kurzen Benefit-Satz um. Features: Leichte Bauweise, 12h Akku, Wasserdicht. Benefit: Genieße Musik den ganzen Tag, egal wo du bist – dank ultraleichtem Design und wasserfestem Gehäuse. Features: 4k Auflösung, HDR, Smart-TV Funktionen. Benefit: Erlebe Kinoqualität in deinem Wohnzimmer mit gestochen scharfen Bildern und direktem Zugang zu deinen Lieblings-Apps. Features: Ergonomischer Griff, rostfreier Stahl, Spülmaschinenfest. Benefit: [KI generiert hier den passenden Satz]

Diese Beispiele geben dem Modell Inhalt, Tonalität und Satzlänge gleichzeitig vor.

Wer tiefer in die Basis-Strukturen einsteigen möchte, findet im Artikel zu Prompting Grundlagen weitere Ansätze.

Best Practices für besseres In-Context Learning

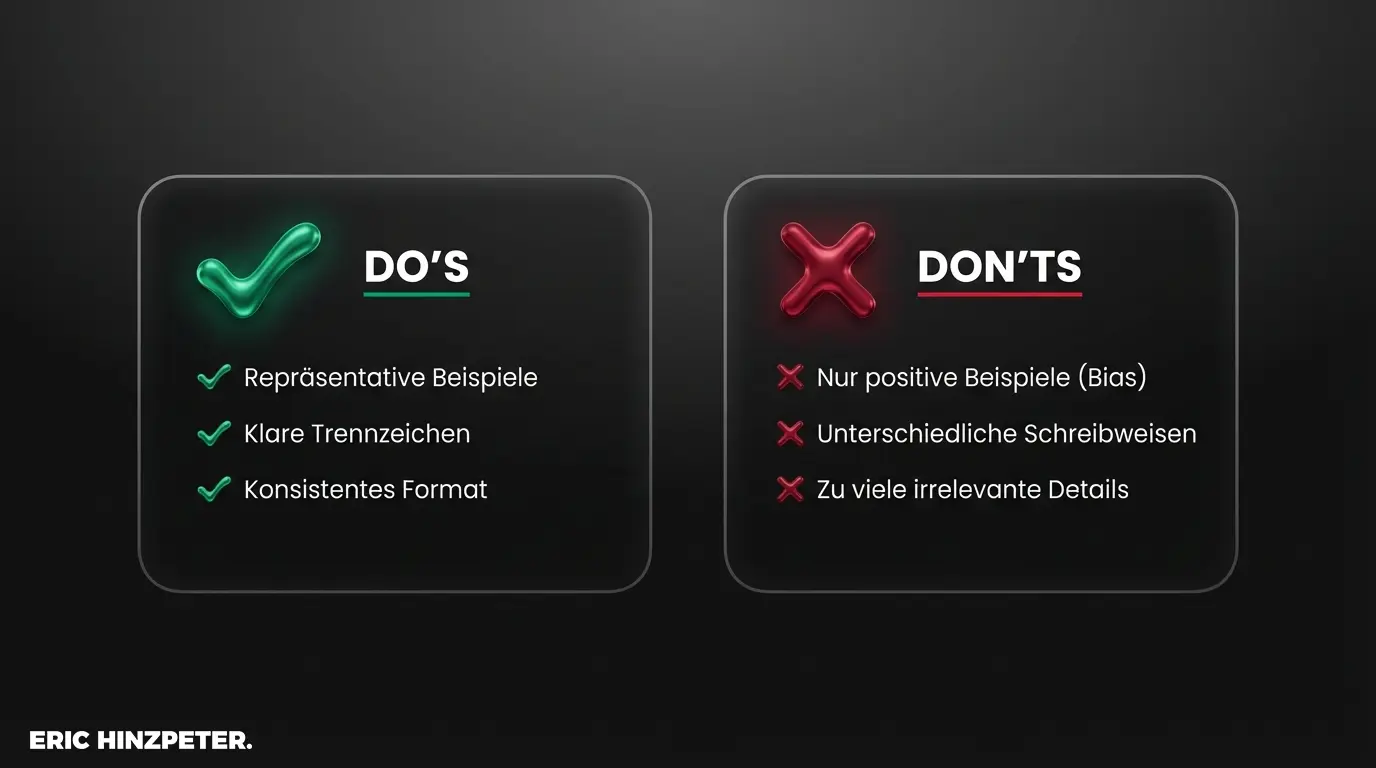

Das Prompt-Design entscheidet über die Qualität des In-Context Learning. Ein häufiger Fehler ist die willkürliche Wahl der Beispiele.

- Vielfalt der Beispiele: Die „Shots“ müssen repräsentativ für den gesamten Aufgabenbereich sein. Wenn alle Beispiele kurz sind, wird auch der Output kurz sein. Eine ausgewogene Verteilung der Klassen (z.B. gleich viele positive wie negative Beispiele) verhindert Bias.

- Konsistente Formatierung: Nutze klare Trennzeichen (z.B. `###` oder `—`) zwischen den Beispielen. Inkonsistenzen im Prompt-Design verwirren das Modell.

- Chain-of-Thought Integration: Bei komplexen logischen Aufgaben lohnt es sich, Chain-of-Thought anzuwenden. Das Beispiel enthält dann nicht nur die Antwort, sondern auch den Lösungsweg („Schritt 1: Analyse… Schritt 2: Fazit…“).

Für fortgeschrittene Techniken und aktuelle Forschungsstände lohnt sich oft ein Blick auf Ressourcen wie PromptingGuide.ai.

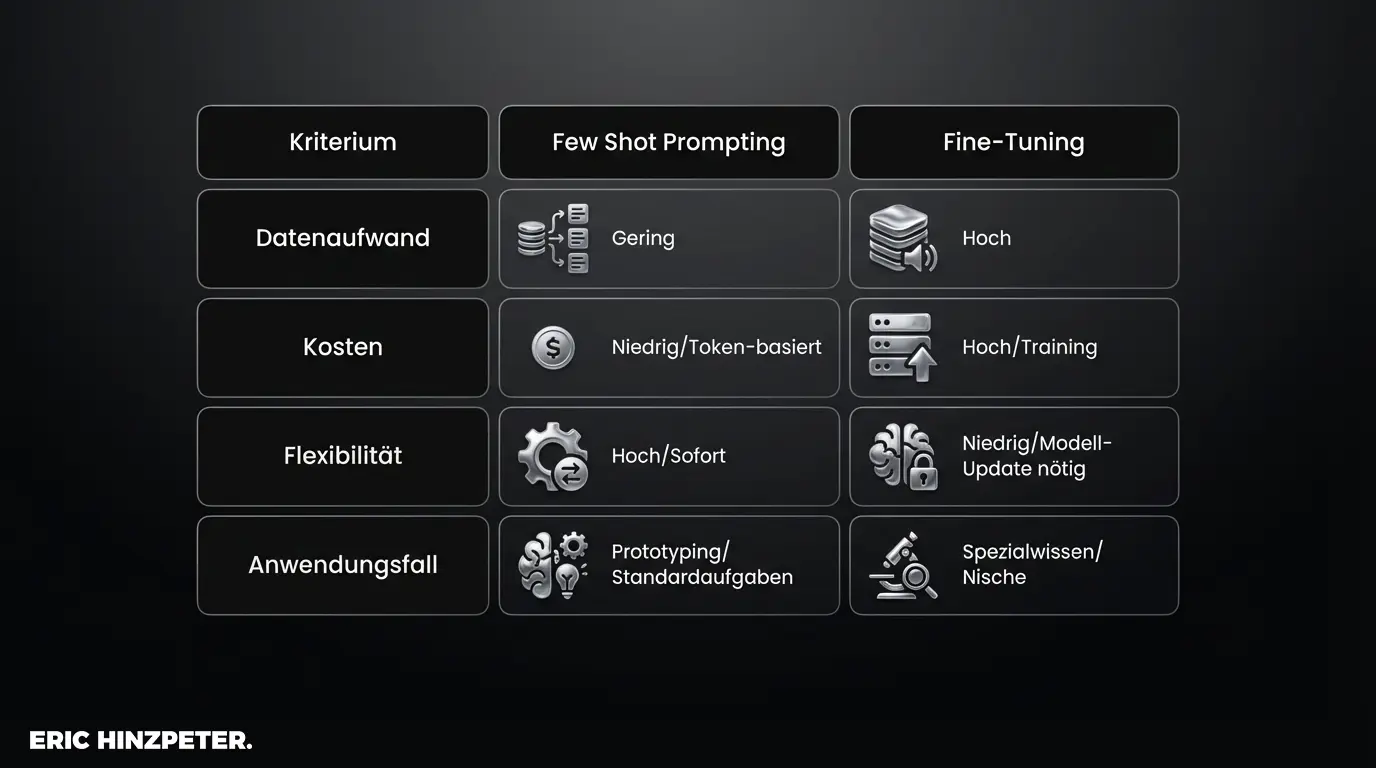

Few Shot Prompting vs. Fine-Tuning

Wann reicht der Prompt, und wann muss das Modell trainiert werden? Der Vergleich Few Shot Prompting vs. Fine-Tuning ist eine Abwägung von Flexibilität gegen Spezialisierung.

Few Shot Prompting braucht keine Anpassung der Modellgewichte, keine Hardware-Ressourcen für das Training und lässt sich in Sekunden iterieren. Es ist ideal, wenn die Aufgabe mit 5–10 Beispielen klar definiert ist.

Fine-Tuning hingegen verändert das Modell dauerhaft. Es braucht kuratierte Trainingsdaten (oft Tausende) und Rechenleistung. Es macht Sinn, wenn das Modell tiefes, branchenspezifisches Fachwissen benötigt, das nicht in den Kontext eines Prompts passt, oder wenn ein sehr spezifischer Sprachstil über Millionen von Interaktionen kosteneffizient repliziert werden muss.

Häufige Fehler und Herausforderungen

Ein bekanntes Problem ist der sogenannte „Label Bias“. Wenn die Beispiele im Prompt überwiegend eine bestimmte Antwortkategorie (z.B. „Positiv“) zeigen, tendiert das Modell dazu, diese Kategorie auch bei neutralem Input zu wählen. Die Verteilung im Prompt beeinflusst die Verteilung im Output direkt.

Ein technischer Engpass ist das Token-Limit. Jedes Beispiel verbraucht Platz im Kontext-Fenster des Modells. Bei sehr langen Beispielen kann es passieren, dass für die eigentliche Aufgabe oder die Antwort der Platz ausgeht. Qualität vor Quantität. Mehr dazu im Glossar-Eintrag zu Token-Limits.

Pro-Tipp: Recency Bias vermeiden

Sprachmodelle gewichten Informationen, die am Ende des Prompts stehen, oft stärker. Wenn deine Beispiele eine bestimmte Reihenfolge haben, mische sie durch oder platziere das wichtigste Format-Beispiel möglichst nah an der finalen Aufgabenstellung.

Fazit & Ausblick

Few Shot Prompting macht die Arbeit mit LLMs kontrollierbarer. Statt auf Glück zu setzen, gibst du dem Modell einen klaren Rahmen, der zeigt, wie eine gute Antwort aussieht. Während Zero-Shot Prompting für generische Aufgaben ausreicht, ist Few-Shot der Standard für professionelle Anwendungen.

Mit wachsenden Kontext-Fenstern entwickelt sich die Technik hin zum „Many-Shot Prompting“, bei dem Modelle ganze Bücher als Input verarbeiten können. Das Grundprinzip bleibt dabei gleich: Die Qualität des Outputs hängt direkt von der Qualität der im Kontext bereitgestellten Muster ab.