Was ist ein Prompt? Definition und Erklärung

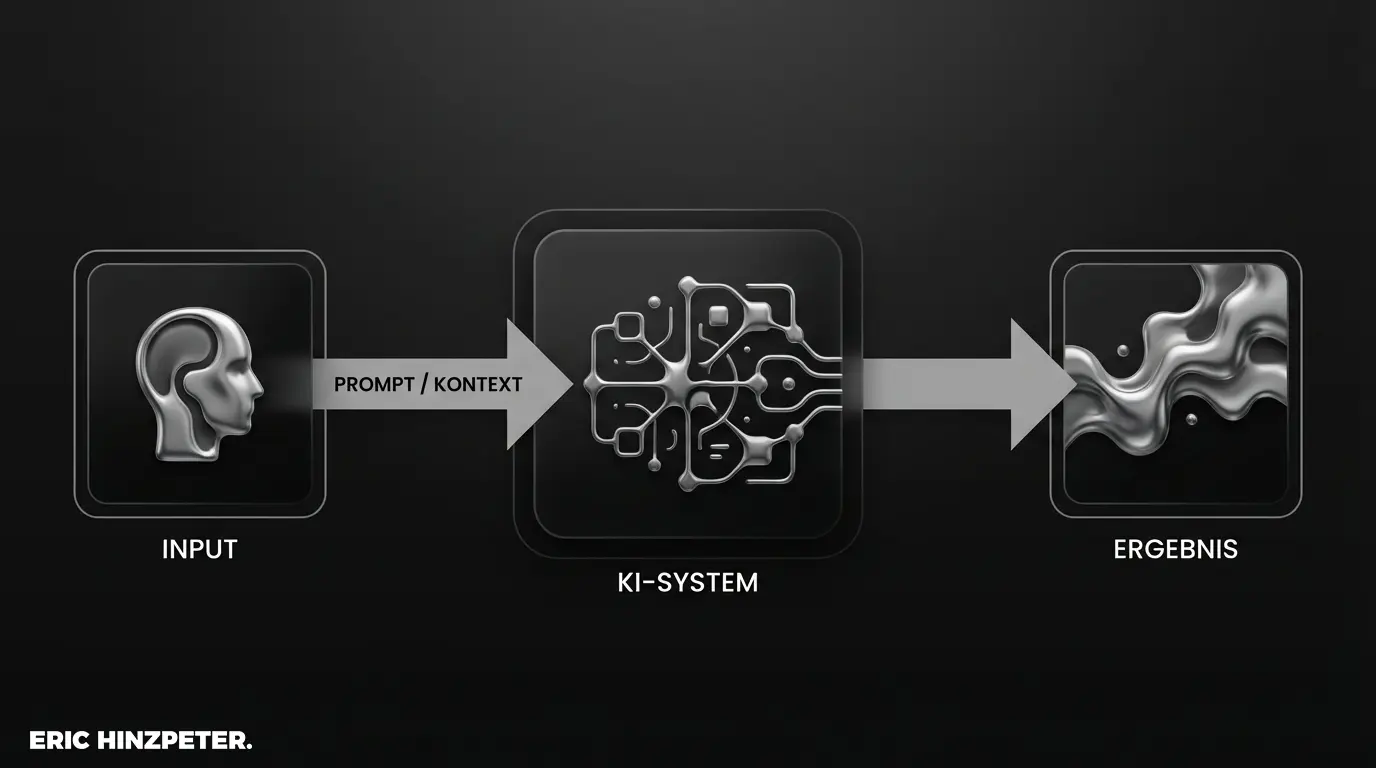

Ein Prompt ist dein Eingabebefehl an die Künstliche Intelligenz. Er übersetzt das, was du erreichen willst, für die Maschine. Der große Unterschied zur klassischen Programmierung: Du schreibst keinen starren Code, sondern nutzt ganz natürliche Sprache.

Die Logik folgt einem klaren Prinzip: Input bestimmt Output. Denk dabei an ein Briefing für einen externen Dienstleister. Bleibt die Anweisung vage („Mach mal ein Konzept“), rät das Modell nur. Definierst du hingegen Rahmenbedingungen, Zielgruppe und Format („Erstelle ein Sicherheitskonzept für Cloud-Infrastrukturen im Bankensektor“), liefert das System präzise Ergebnisse. Genau so arbeiten aktuelle Sprachmodelle. Sie brauchen eine glasklare Anweisung – den Prompt –, um Text, Code oder Bilder effizient zu erzeugen.

Viele reduzieren das Thema auf reine Text-Fragen. Aber im Hintergrund passiert mehr: Der Prompt setzt den Kontext, in dem das neuronale Netz operiert.

Du willst tiefer in die Mechanik einsteigen? Mehr Details findest du in unserem Guide zu den Prompting Grundlagen.

Warum ist Prompt Engineering so wichtig?

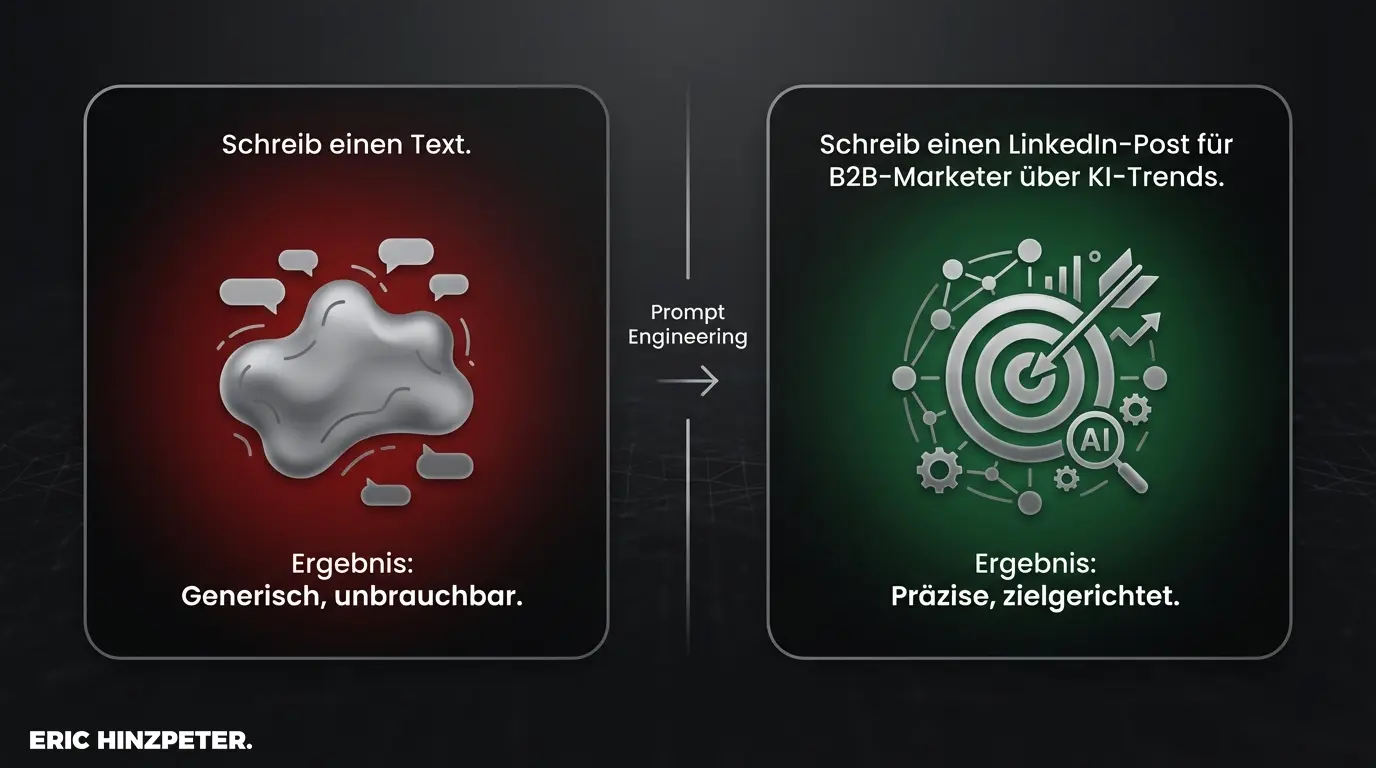

Hier greift ein fundamentales Prinzip der Informatik: „Garbage In, Garbage Out“. Ein schlechter Input führt zu unbrauchbaren Antworten – egal, wie mächtig das KI-Modell ist. Wer seine Eingaben gezielt strukturiert und verfeinert, betreibt Prompt Engineering.

Das hat wenig mit kreativem Schreiben zu tun, sondern erfordert eher technisches Verständnis. Es ist die Kompetenz, die Maschine so zu kalibrieren, dass Halluzinationen minimiert werden und du verlässliche Antworten bekommst. Gute Prompts sparen im Alltag massiv Zeit: Statt in endlosen Korrekturschleifen festzuhängen, erzwingst du durch eine klare Struktur sofort ein verwertbares Ergebnis.

Die Struktur eines perfekten Prompts

Starke Prompts funktionieren fast immer wie ein Baukasten. Wer dieses Prinzip einmal verinnerlicht hat, wird unabhängig vom spezifischen Tool reproduzierbare Resultate erzielen.

Insight: Die 4-W-Logik

Prüfe deinen Prompt immer auf diese vier Bausteine: Wer (Rolle), Was (Aufgabe), Wie (Format) und Wofür (Kontext). Fehlt ein Parameter, muss die KI auf Wahrscheinlichkeiten zurückgreifen – und du landest beim Durchschnitt.

Kontext, Persona und Ausgabeformat

Damit die KI nicht nur statistisch wahrscheinliche Worte aneinanderreiht, sondern in deinem Sinne agiert, braucht sie Leitplanken:

- Persona: Mit Phrasen wie „Handle als…“ gibst du der KI eine Rolle vor. Ein Senior-Stratege formuliert anders als ein Junior-Texter.

- Kontext: Erkläre die Hintergründe. Wer ist die Zielgruppe? Was ist das Ziel? Ohne Kontext bleibt die Antwort generisch.

- Ausgabeformat: Sag direkt, was du brauchst. Eine Tabelle, Python-Code oder Fließtext? Das Ausgabeformat diktiert die Struktur des Outputs.

Ein kurzer Blick auf Tokens und Parameter

KI-Modelle lesen eigentlich keine Wörter. Sie verarbeiten Tokens. Grundsätzlich kann man Tokens als semantische Einheiten oder Silben verstehen. Ein Wort entspricht grob 0,75 Tokens. Das ist die Recheneinheit, die über Kosten und Kontext-Limit entscheidet.

Außerdem kannst du Modelle über Parameter feinsteuern. Der bekannteste Wert ist die „Temperature“. Ein hoher Wert sorgt für kreativere Texte, ein niedriger Wert sorgt für deterministische, faktenorientierte Antworten.

Wichtige Techniken: Zero-Shot vs. Few-Shot

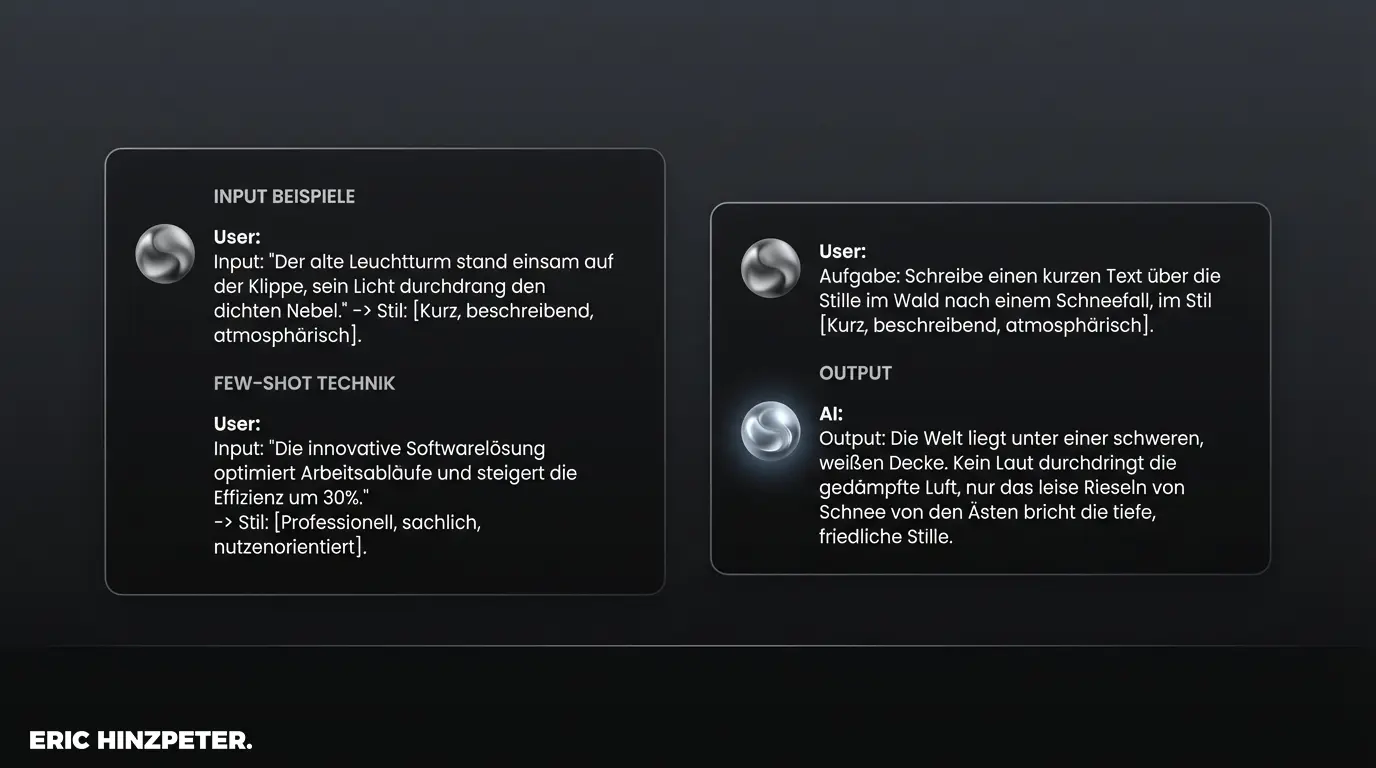

Beim Prompting unterscheiden wir in der Praxis meist zwei grundlegende Methoden:

Zero-Shot bedeutet, du stellst der KI eine Aufgabe ohne Referenzdaten.

Beispiel: „Schreibe einen Tweet über SEO.“

Few-Shot bedeutet, du lieferst der KI Referenzbeispiele (Shots), um das Muster vorzugeben.

Beispiel: „Schreibe einen Tweet über SEO. Orientiere dich an diesem Aufbau: [Beispiel 1], [Beispiel 2].“

Meine Erfahrung im Alltag bestätigt: Few-Shot Prompts liefern fast immer qualitativ hochwertigere Ergebnisse. Das Modell übernimmt die Struktur der Beispiele direkt und spart dir unnötige Korrekturen.

Tipps für bessere ChatGPT Prompts

Der größte Fehler im Umgang mit Chatbots: Viele erwarten direkt beim ersten Versuch den perfekten Text. Aber die Stärke von LLMs (Large Language Models) liegt in der Iteration.

Nutze die Tools lieber als Sparringspartner. Schreib zum Beispiel: „Die Argumente passen, aber mach den zweiten Absatz kürzer und lockere den Ton auf.“ Durch dieses iterative Eingreifen näherst du dich dem Optimum an. Passende Helfer dafür stelle ich dir in meiner Übersicht der Top KI-Tools im Content Marketing vor.

Pro-Tipp: Strategie vor Taktik

Nutze ChatGPT nicht nur zur Exekution, sondern zur Validierung. Frag das Modell nach Feedback: „Analysiere meine Argumentation auf logische Lücken.“ Das bietet oft mehr strategischen Mehrwert, als nur reine Texte generieren zu lassen.

Anleitung für Bild-KI Prompts wie Midjourney

Text-Modelle verarbeiten Logik. Dagegen benötigen Systeme zur Bildgenerierung wie Midjourney oder DALL-E eine deskriptive, visuelle Syntax. Wir sprechen hier von Prompt-Design.

Lange Sätze bringen dich hier nicht weiter. Am besten funktionieren gezielte Ketten von Schlagwörtern: „Cinematic lighting, photorealistic, 8k resolution, cyberpunk style“. Im Zweifel gilt: Die visuelle Semantik wiegt hier schwerer als die grammatikalische Korrektheit.

Häufige Fehler bei der Eingabe vermeiden

Selbst die stärksten Modelle stolpern, wenn der Prompt handwerkliche Fehler hat:

- Logische Widersprüche: „Schreibe ausführlich, aber fasse dich kurz.“ Solche Paradoxien destabilisieren den Output.

- Fehlender Kontext: Lässt du die Zielgruppe offen, wählt die KI den statistischen Durchschnitt – und dein Text klingt generisch.

- Kognitive Überladung: Packst du sämtliche Anweisungen in einen einzigen Prompt, vergisst das Modell schnell Details. Besser: Zerlege komplexe Aufgaben in sequentielle Schritte (Chain-of-Thought).

Prompting als neues Handwerkszeug

Gute Prompts sind die fundamentale Schnittstelle der Interaktion mit intelligenten Systemen. Auch wenn die Tools sich rasant weiterentwickeln, bleibt die Fähigkeit zur präzisen Instruktion eine Schlüsselkompetenz. Wer versteht, wie Modelle ihre Eingaben verarbeiten, hat die volle Kontrolle über die Ergebnisse. Es lohnt sich also, das Prompten nicht als Workaround, sondern als strukturiertes Kommunikationsmodell zu verstehen.