Mal ehrlich: Warum liefert die KI dem einen Nutzer geniale Insights, während sie beim nächsten nur generischen Müll ausspuckt? In der aktuellen KI-Debatte wird eine Sache ständig übersehen: Die Qualität des Outputs korreliert fast linear damit, wie viel Hirnschmalz du in den Input steckst. Hier trennen die Grundlagen des Promptings die Profis von den Amateuren.

Ein Blick unter die Haube zeigt: Die KI versteht deine Gedanken nicht – sie verarbeitet Muster. Wer diese Muster nicht bedienen kann, lässt das Potenzial der Technologie einfach liegen. Dieser Guide schaut sich die Architektur hinter Prompts an, die wirklich funktionieren – von der Anatomie eines Befehls bis zu den harten Fakten von OpenAI und Anthropic.

Pro-Tipp: Dokumentation statt Improvisation

Hör auf, jedes Mal bei Null anzufangen. Leg dir eine „Prompt-Library“ an. Wer funktionierende Strukturen speichert, spart nicht nur massiv Zeit, sondern sorgt auch dafür, dass die Qualität nicht jedes Mal vom Zufall abhängt.

Was bedeutet Prompting eigentlich?

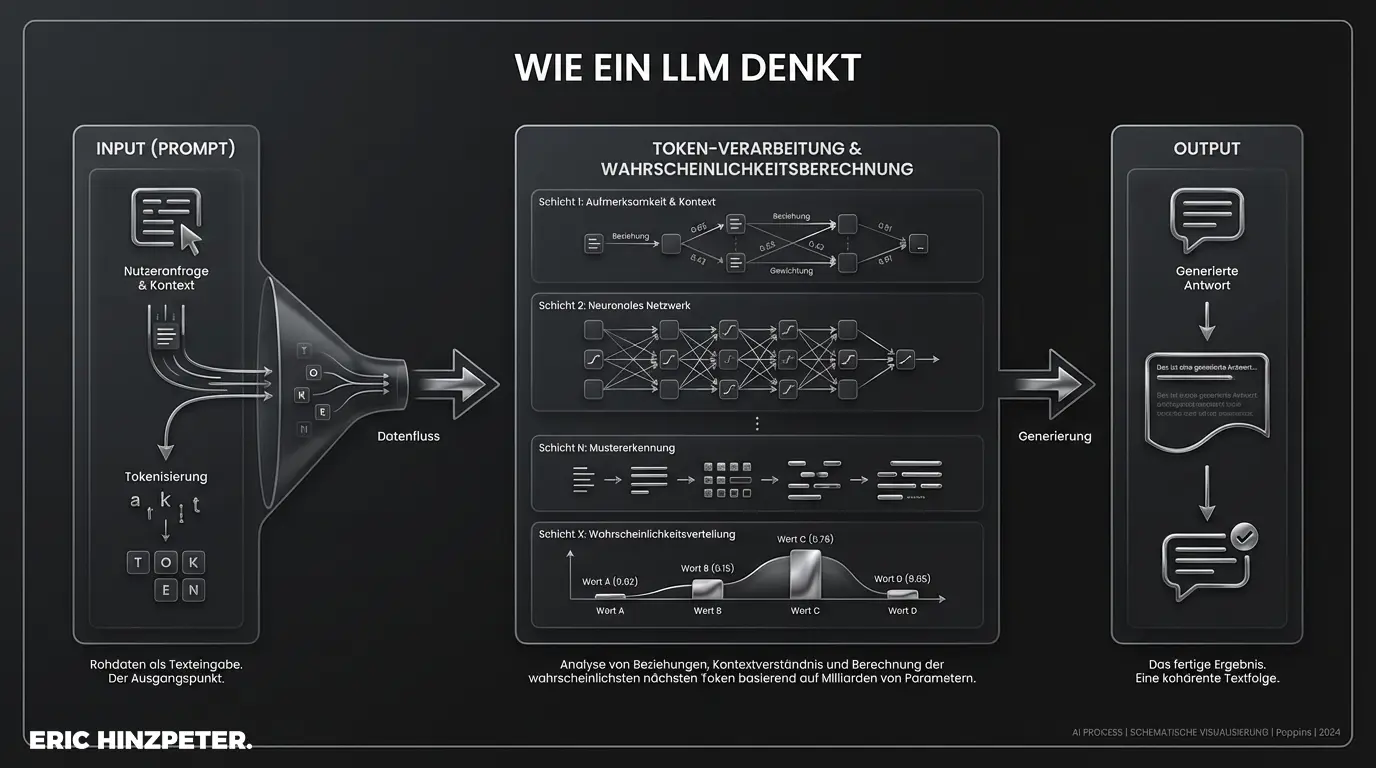

Technisch gesehen ist ein Prompt die Schnittstelle zwischen deiner Absicht und der Ausführung der Maschine. Das ist keine nette Plauderei, sondern ein Befehlssatz (Command), der Wahrscheinlichkeiten steuert.

Große Sprachmodelle (LLMs) wie GPT-4 oder Claude sind im Grunde probabilistische Maschinen. Sie berechnen Token für Token, was als Nächstes am wahrscheinlichsten kommt. Dein Prompt setzt die Leitplanken für diese Berechnung. Hier gilt das eiserne IT-Gesetz: „Garbage In, Garbage Out“.

Wer unpräzise fragt („Schreib was über Marketing“), bekommt statistischen Durchschnitt. Wer systemisch instruiert, bekommt echte Expertise. Im Gegensatz zur Google-Suche, wo wir nur in einem Index graben, konstruieren wir beim Prompt Engineering neue Inhalte durch präzise Ansagen.

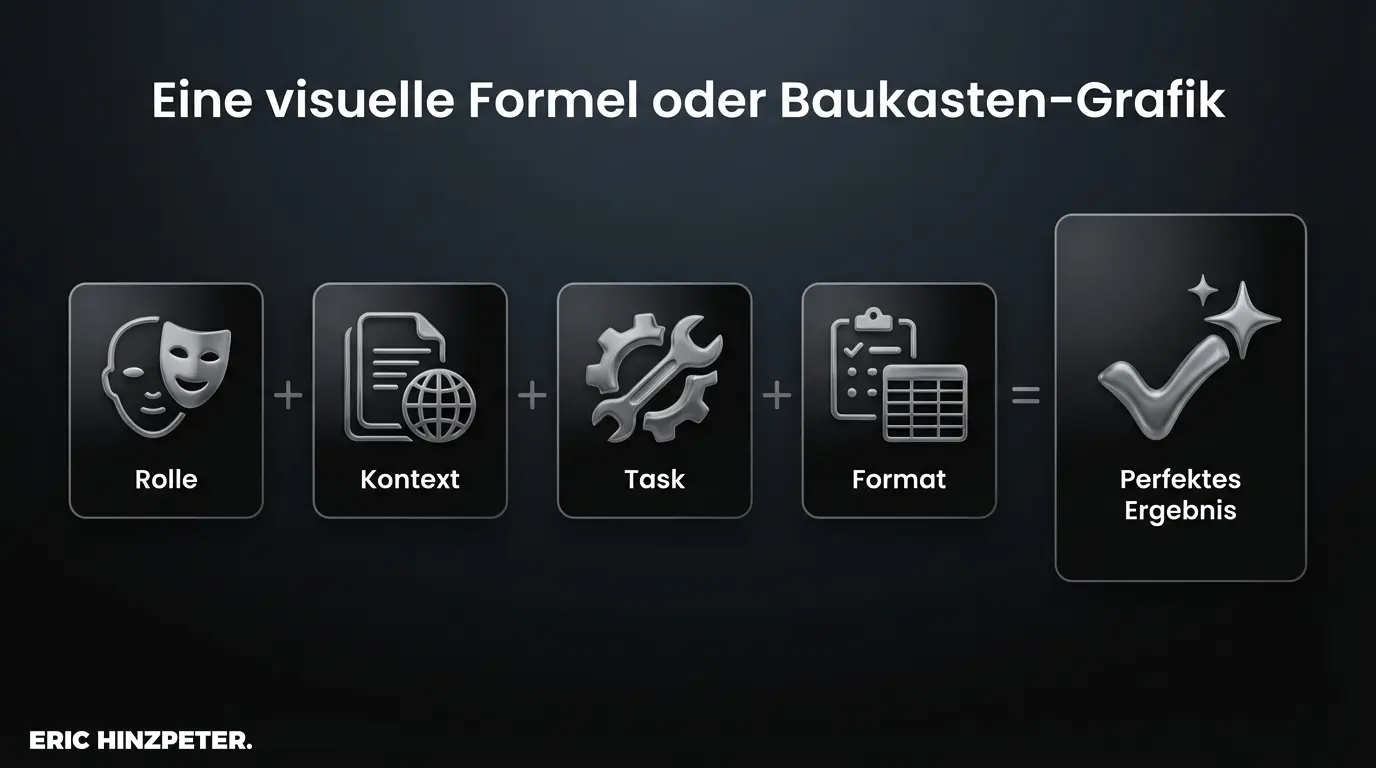

Die Anatomie eines perfekten Prompts

Wenn man sich die Dokumentationen von Anthropic oder OpenAI anschaut, sieht man schnell: Ein guter Prompt ist kein Einzeiler. Er gleicht eher einem Mini-Programm mit vier Bausteinen:

- Rolle (Persona): Wer soll die KI sein? (Simuliere die Expertise)

- Kontext: Was muss die KI wissen? (Rahmenbedingungen)

- Aufgabe (Task): Was genau soll passieren? (Nutze klare Verben)

- Format: Wie soll das Ergebnis aussehen? (Strukturvorgabe)

In den Grundlagen im Content Marketing lernen wir, wie wichtig die Zielgruppe ist. Bei der KI ist es genau dasselbe: Fehlende Details sind der Killer für jedes Ergebnis.

Praxis-Check: Schwach vs. Stark

Der „Nackte“ Prompt (Vergiss es): „Schreib einen Text über B2B-Marketing.“

Der Profi-Prompt (So wird’s was): „Handle als Senior Marketing Strategist (Rolle). Wir verkaufen SaaS-Logistik-Software an CEOs (Kontext). Schreib einen LinkedIn-Post über die Risiken manueller Lieferketten. Starte mit einer provokanten These (Anweisung). Kurze Absätze, Bulletpoints, kein Marketing-Blabla (Format).“

Durch klare Anweisungen zwingst du ChatGPT oder Claude dazu, den langweiligen Standard-Modus zu verlassen.

Warum Personas keine Spielerei sind

„Role Prompting“ funktioniert deshalb so gut, weil die Zuweisung einer Persona den Suchraum der KI massiv einschränkt. Das Modell fokussiert sich auf einen spezifischen Bereich.

Ohne Persona nutzt die KI den Durchschnitt aus dem ganzen Internet. Mit Persona nutzt sie die Muster, die zu dieser Rolle passen. Nutze den Kontext auch, um den Ton zu setzen:

- „Erklär es so, dass es ein 10-Jähriger versteht.“

- „Analysiere das nüchtern und knallhart datengestützt.“

Das ist der Schlüssel, wenn du authentische KI-Inhalte erstellen willst, die nicht nach Roboter klingen.

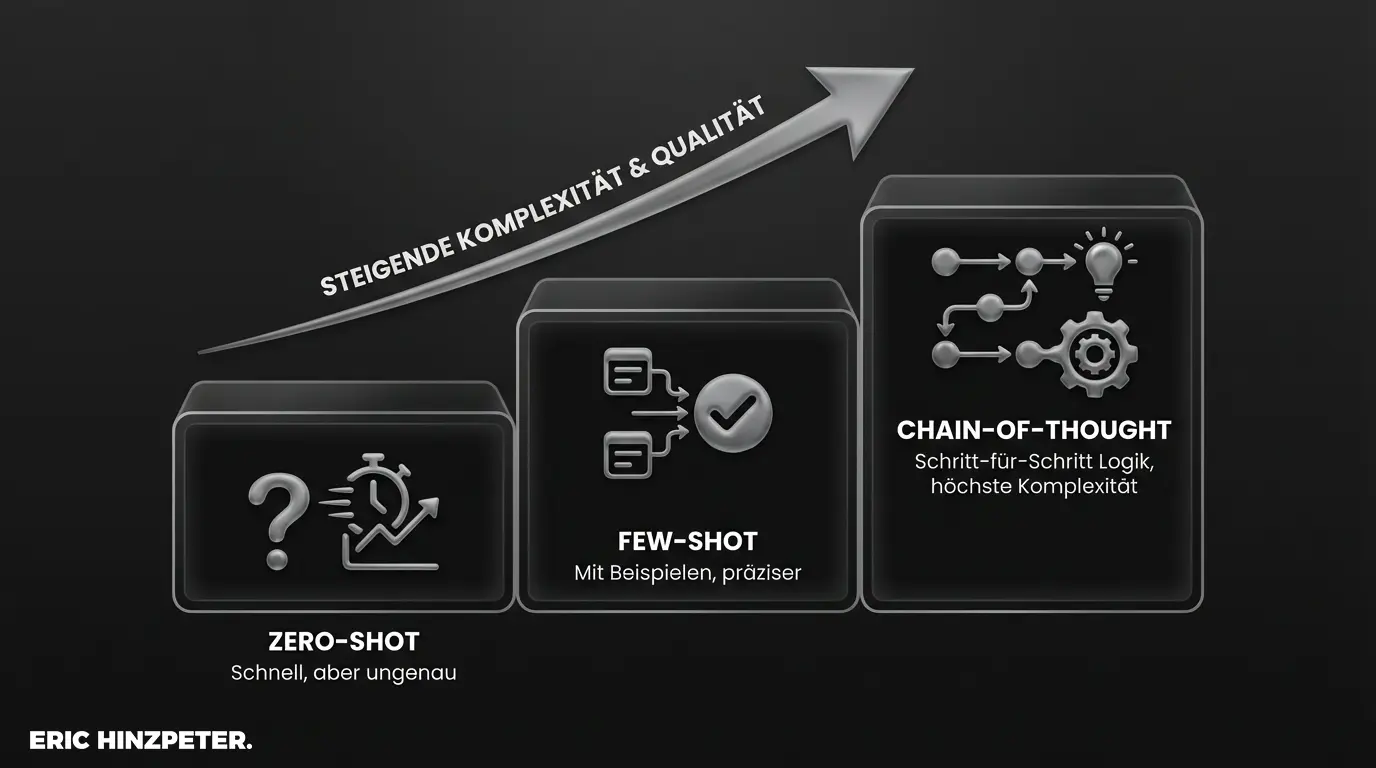

Zero-Shot vs. Few-Shot: Die Profi-Strategien

Nicht jede Aufgabe braucht den gleichen Aufwand. Es gibt eine klare Hierarchie:

1. Zero-Shot-Prompting

Du gibst eine Anweisung ohne Beispiele. Funktioniert für einfaches Wissen („Wann war der Mauerfall?“), scheitert aber oft an komplexen Formaten.

2. Few-Shot-Prompting

Du gibst 1-3 Beispiele mit, wie das Ergebnis aussehen soll. Laut OpenAI steigert das die Erfolgsrate bei schwierigen Aufgaben massiv. Du zeigst der KI einfach die Schablone.

3. Chain-of-Thought (CoT)

Für Logik-Probleme sagst du der KI explizit: „Denke Schritt für Schritt“. Das zwingt das Modell, Zwischenschritte zu berechnen, statt direkt (und oft falsch) zum Ergebnis zu springen.

Pro-Tipp: Strategisch wählen

Nimm Zero-Shot für Fakten. Wechsle sofort zu Few-Shot, wenn du einen bestimmten Schreibstil oder ein Datenformat (wie JSON) brauchst. Beispiele sind die beste Versicherung gegen schlechte Ergebnisse.

Workflow: So baust du einen Prompt

Professionelles Prompting ist ein iterativer Prozess. Profis arbeiten so:

- Entwurf: Bau den Prompt nach der Anatomie oben zusammen.

- Testlauf: Schick ihn ab.

- Check: Wo weicht die KI ab? Ist der Ton zu steif? Fehlt was?

- Veredelung: Füge Einschränkungen (Constraints) hinzu. „Guter Text, aber mach ihn kürzer und lass die Floskeln weg.“

Ein Technik-Hack: Nutze Trennzeichen (Delimiters) wie ### oder ---, um deine Anweisungen klar von den Daten zu trennen. Dann weiß die KI genau, was Befehl und was Quelltext ist.

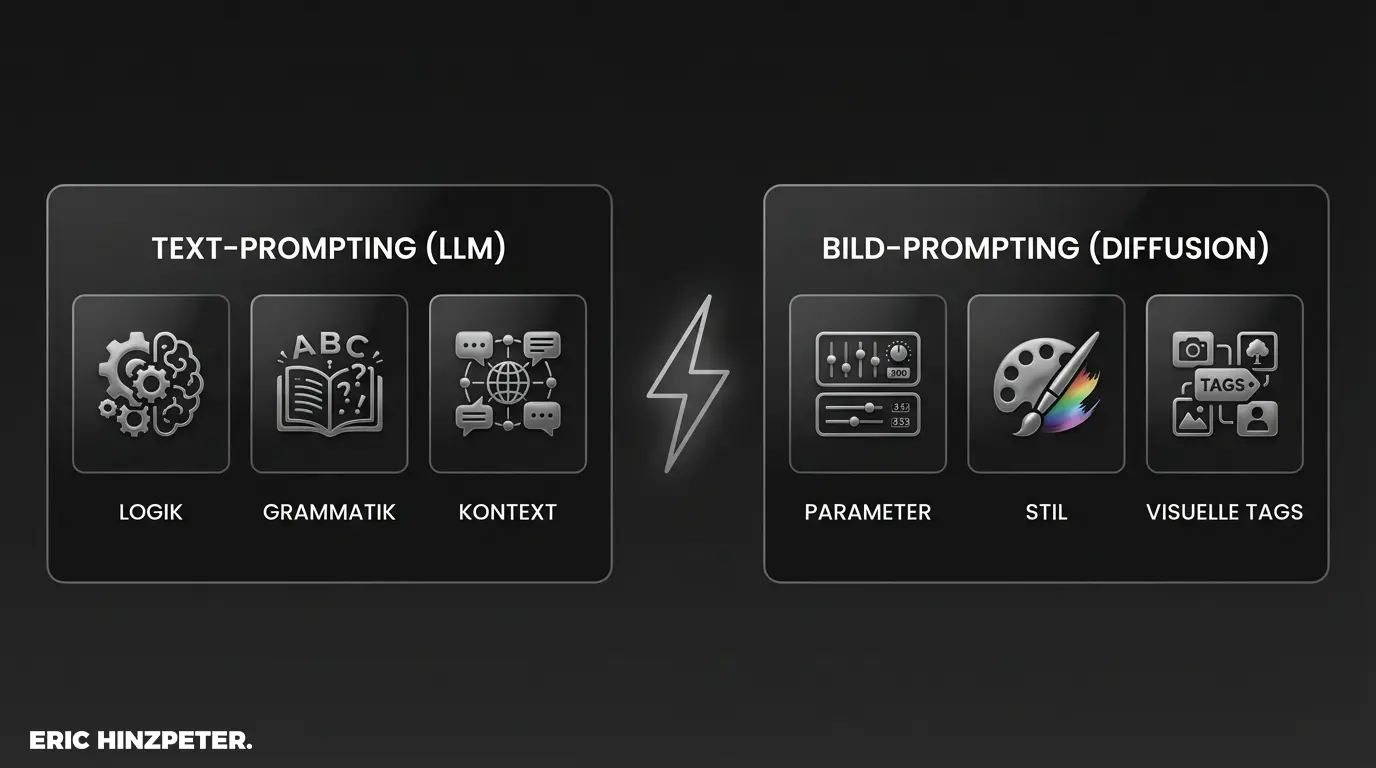

Text vs. Bild: Zwei Welten

Während LLMs auf Logik und Grammatik stehen, sprechen Bild-Generatoren wie Midjourney eine andere Sprache. Hier zählen visuelle Assoziationen mehr als komplizierte Sätze.

Bei Text-zu-Bild zählen Schlagworte statt Satzbau:

- Parameter: Steuerbefehle wie

--ar 16:9. - Stil-Referenzen: „Cinematic lighting“, „Cyberpunk style“.

- Keine Höflichkeit: Midjourney ignoriert „Bitte“ und „Danke“. Hier gilt: Schlagwort schlägt Grammatik.

Häufige Fehler (und wie du sie vermeidest)

1. Halluzinationen blind glauben

KIs wollen eine Antwort liefern – egal ob sie stimmt oder nicht. Wenn sie nichts wissen, erfinden sie oft was. Lösung: Erlaube der KI, „Ich weiß es nicht“ zu sagen, wenn sie im Kontext nichts findet.

2. „Schreibe nicht…“

Negative Prompts wie „Schreibe nicht langweilig“ versteht die KI oft falsch und konzentriert sich erst recht auf das Wort „langweilig“. Lösung: Formuliere positiv. „Schreibe spannend und aktivierend.“

Tools für deine Prompt-Effizienz

Die KI-Tools im Content Marketing entwickeln sich rasend schnell. Nutze Ressourcen wie offizielle Guides von OpenAI oder Anthropic. Das sind die Quellen, die die Architektur wirklich kennen.

Fazit: Logik schlägt Magie

Prompting ist kein Hexenwerk, sondern erfordert logisches Denken und Präzision. Wer die Grundlagen Prompting beherrscht, bedient keine Black Box mehr, sondern steuert eine Maschine. Theorie ist nett, aber am Ende zählt die Logik der Anwendung.