Was ist ein Token? – Eine einfache Erklärung

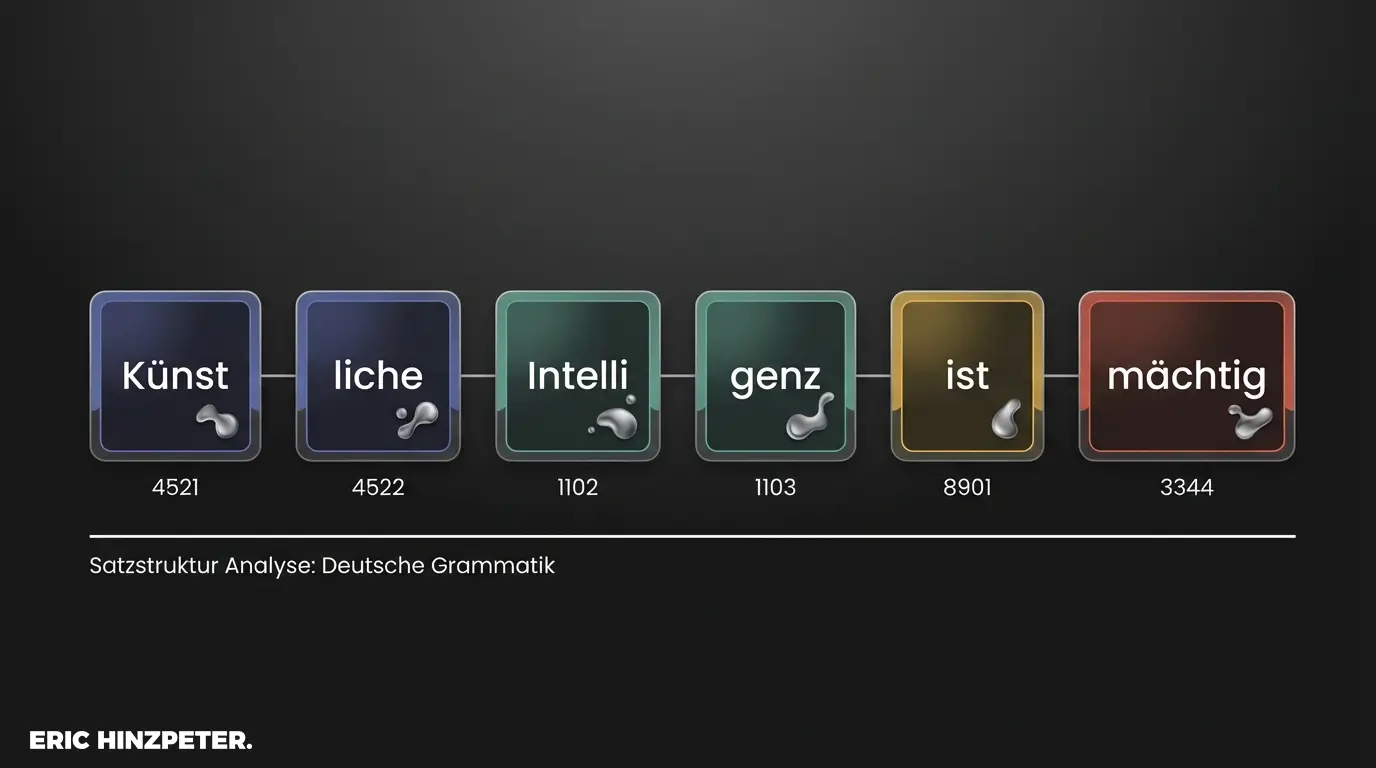

Wer die Arbeitsweise von Large Language Models (LLMs) wie ChatGPT 5.4 oder Claude 4.6 verstehen will, muss umdenken. Maschinen lesen keine Wörter, sie verarbeiten Tokens. Technisch gesehen sind Tokens die atomaren Grundeinheiten der Informationsverarbeitung. Ein Token ist dabei nicht immer ein ganzes Wort. Oft handelt es sich um Silben, Wortteile oder einzelne Satzzeichen. Das Modell zerlegt den Input in diese kleinsten sinnvollen Sequenzen, um damit rechnen zu können.

Wir setzen Token und Wort im Alltag oft gleich – das ist ein Fehler. Die technische Faustformel für die Kalkulation lautet:

Im Englischen: 1.000 Token entsprechen etwa 750 Wörtern.

Im Deutschen sieht das anders aus. Weil wir lange, zusammengesetzte Wörter nutzen, ist unsere „Token-Dichte“ höher. Hier entsprechen 1.000 Token eher 600 bis 700 Wörtern.

Diese Stückelung passiert nicht ohne Grund. Sie ist eine Notwendigkeit der Vektorisierung. Erst durch die Zuweisung einer numerischen ID wird Sprache für den Algorithmus greifbar.

Wenn du saubere Prompts entwickeln willst, solltest du diese Granularität im Hinterkopf behalten.

Für die Analyse deiner eigenen Texte lohnt sich ein Blick auf den offiziellen Tokenizer von OpenAI. Dort siehst du transparent, wie die Modelle deinen Text zerlegen.

Tokenisierung: Wie LLMs Sprache verarbeiten

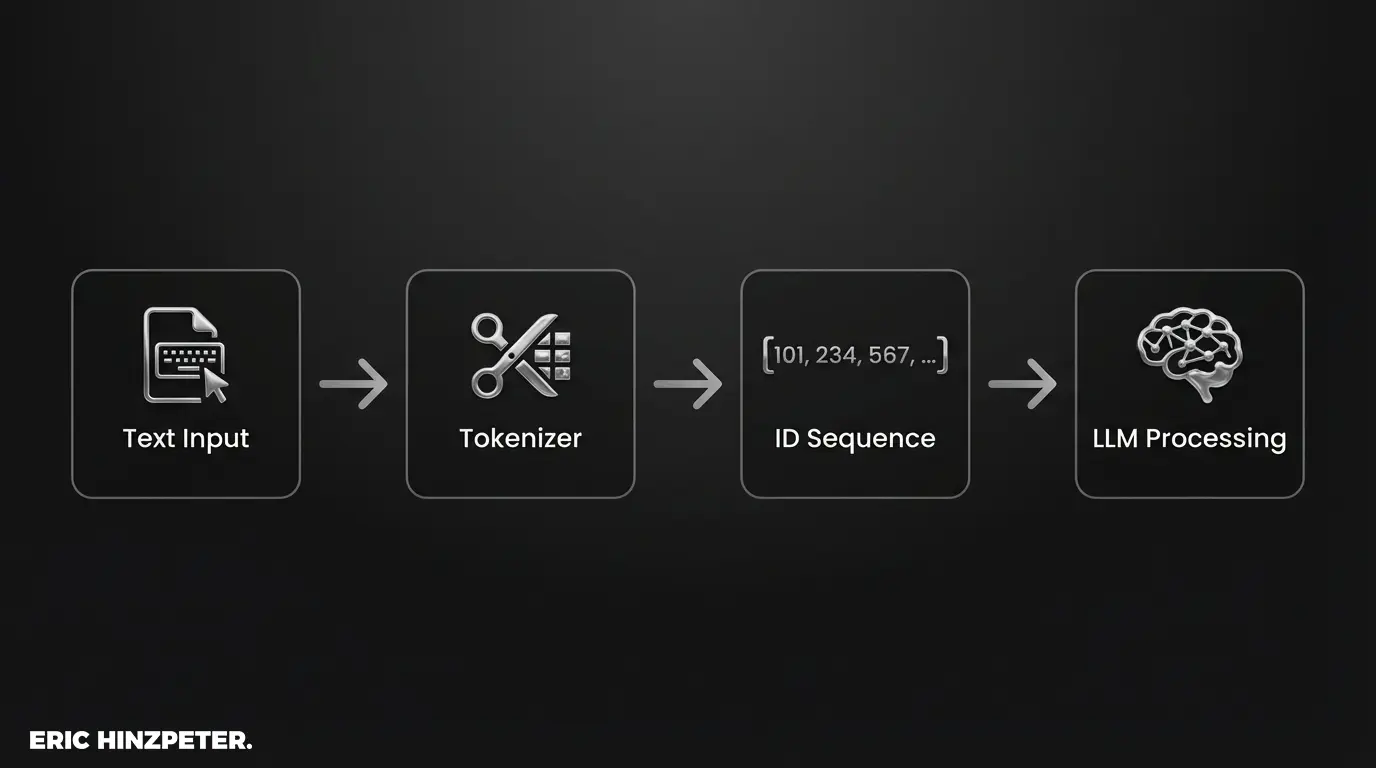

Die Tokenisierung bereitet den Text für die KI auf. Sie übersetzt unstrukturierte Sprache in strukturierte Daten. Ein Computer versteht keine Semantik oder Bedeutung; er benötigt Vektoren – mathematische Repräsentationen in einem Koordinatensystem.

Der Prozess läuft in vier klaren Schritten ab:

- Input: Du gibst deinen Text ein.

- Tokenisierung: Der Text wird in definierte Fragmente zerlegt.

- ID-Zuweisung: Jedem Fragment wird eine Zahl aus dem fixen Vokabular des Modells zugewiesen.

- Vektorisierung: Das System wandelt die Zahlen in Vektoren um, die die semantische Beziehung der Tokens zueinander abbilden.

Ein oft übersehener Faktor ist dabei die Sprach-Effizienz. Ein englischer Satz übersetzt sich oft fast 1:1 in Tokens. Das Deutsche zerlegt Wörter wie „Datenverarbeitung“ in viele Einzelteile und erzeugt so eine deutlich höhere Token-Last. Die Folge: Deutsche Inputs belegen mehr Context Window und kosten bei API-Abfragen mehr als der exakte englische Gegenpart.

Wenn du diese Mechanik kennst, kannst du durch präzises Prompt Engineering gegensteuern. Das hilft nicht nur, um die Qualität der Ausgabe steigern zu können, sondern lässt dich auch die Latenzzeiten deiner KI-Anwendungen optimieren.

Bedeutung von Token für Pricing & Limits

Tokens sind nicht nur Technik, sondern eine echte ökonomische Metrik. Sie definieren sowohl die Kostenstruktur als auch die Leistungsgrenzen deiner Anwendungen.

Das Context Window (Gedächtnis)

Jedes Modell hat ein limitiertes Context Window. Das ist die maximale Menge an Tokens, die das Modell gleichzeitig verarbeiten kann (Input und Output zusammen). Ist dieser Speicher voll, beginnt der Information Loss – die KI „vergisst“ den Anfang eures Gesprächs.

- Frühe Modelle schafften 4.000 Token (ca. 3.000 Wörter).

- Heute lade ich in Modelle wie Gemini 3 Pro oder Claude Opus 4.6 problemlos mehrere Millionen Token – das entspricht ganzen Bibliotheken voller Text oder Code.

Pricing: Die Kosten der Intelligenz

Anbieter wie OpenAI oder Anthropic rechneten historisch rein über das Modell „Cost per 1k Tokens“ ab (heute oft pro Million). Wichtig bleibt dabei: Output-Tokens (Generierung) sind fast immer teurer als Input-Tokens (Analyse). Eine Effizienz im Input korreliert also direkt mit den Betriebskosten.

Pro-Tipp: Ineffizienzen vermeiden

Ich sehe das ständig, wenn ich Workflows in n8n baue oder mit Claude Code experimentiere: Ein unsauberer System-Prompt, der bei jedem API-Call unnötige Füllwörter mitschleift, belastet bei tausendfacher Ausführung das Budget massiv. Reduziere deine Prompts auf die logische Essenz – jedes gesparte Token steigert deine Marge.

Für tiefergehende Analysen zu Modellen und Workflows empfehle ich einen Blick in meinen Blog.

Die fundamentale Logik der KI-Modelle

Auch wenn es philosophisch klingt: Die Tokenisierung ist die Quantifizierung von Realität. Sie macht LLM Information und Sprache berechenbar. Wer versteht, wie Informationen in Tokens zerlegt und verarbeitet werden, ärgert sich seltener über abbrechende Antworten. Und wer dieses System verinnerlicht, begreift die fundamentale Logik moderner digitaler Architekturen.