Was ist Prompt Engineering? – Definition und Grundlagen

Oft stellt sich die Frage, warum leistungsfähige KI-Modelle an scheinbar einfachen Aufgaben scheitern. Die Ursache liegt selten in der mangelnden Intelligenz des Systems, sondern in der Architektur der Eingabe. Prompt Engineering ist die systematische Übersetzung menschlicher Intention in eine für die Maschine verarbeitbare Logik.

Technisch betrachtet ist Prompt Engineering die methodische Gestaltung von Texteingaben für Generative KI. Es geht hierbei nicht um klassisches Programmieren, sondern um linguistische Präzision. Das Ziel ist es, die statistischen Wahrscheinlichkeiten des Modells so zu steuern, dass das Ergebnis – sei es Text, Code oder Bild – qualitativ hochwertig und reproduzierbar ist. Der Unterschied zwischen einer simplen Frage und einem professionellen Prompt liegt in der Struktur: Während eine Frage oft Kontext impliziert, liefert ein guter Prompt den Kontext explizit mit.

Für ein tieferes Verständnis der Begrifflichkeiten lohnt sich ein Blick in unser Glossar zum Thema Was ist ein Prompt?. Hier wird die atomare Einheit der KI-Kommunikation definiert.

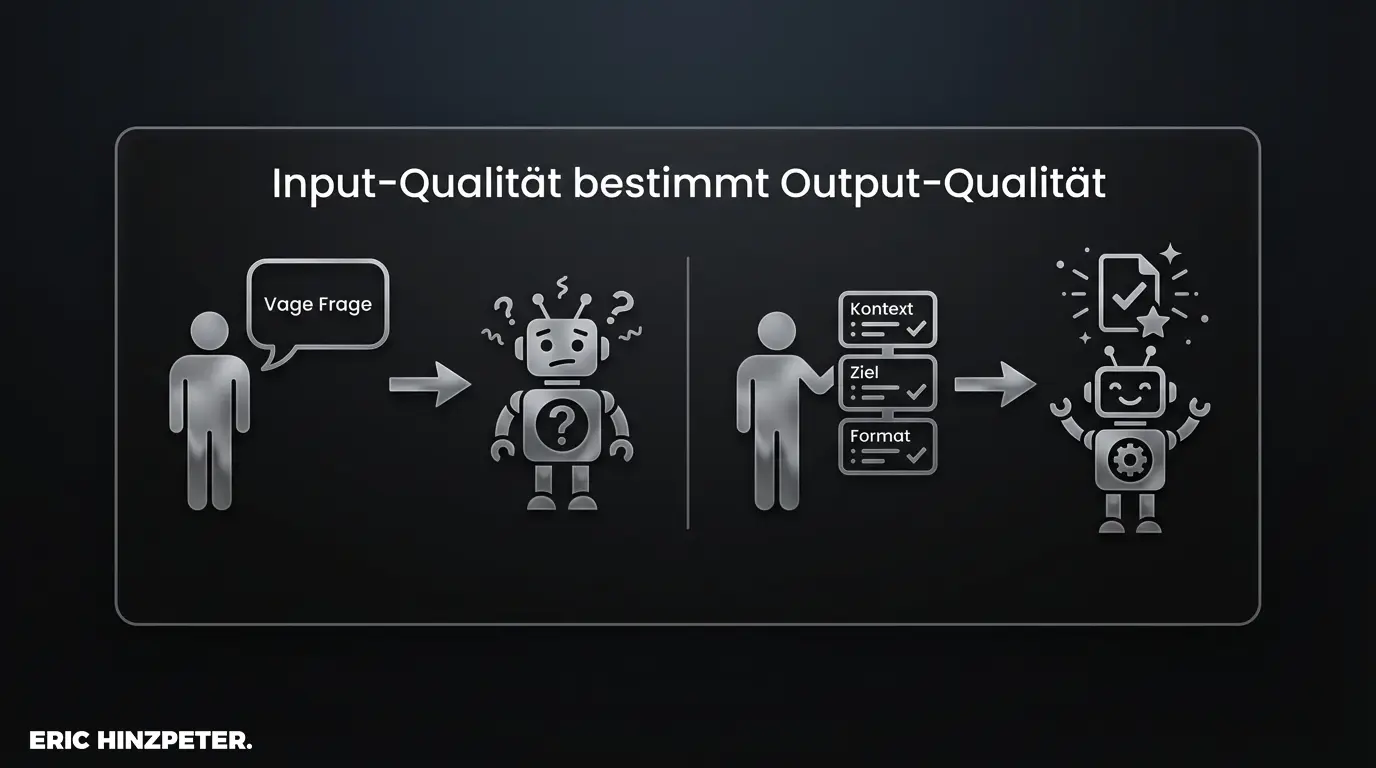

Pro-Tipp: Das „Garbage In, Garbage Out“-Prinzip

Ein Blick auf die Fehlerquellen zeigt: Mangelnde Präzision im Input führt zwangsläufig zu Rauschen im Output. Die Logik des Prompts muss das Ziel definieren, bevor die Generierung startet. Wer das Ergebnis dem Zufall überlässt, erhält keine reproduzierbare Qualität.

Wie funktionieren Large Language Models und Tokens?

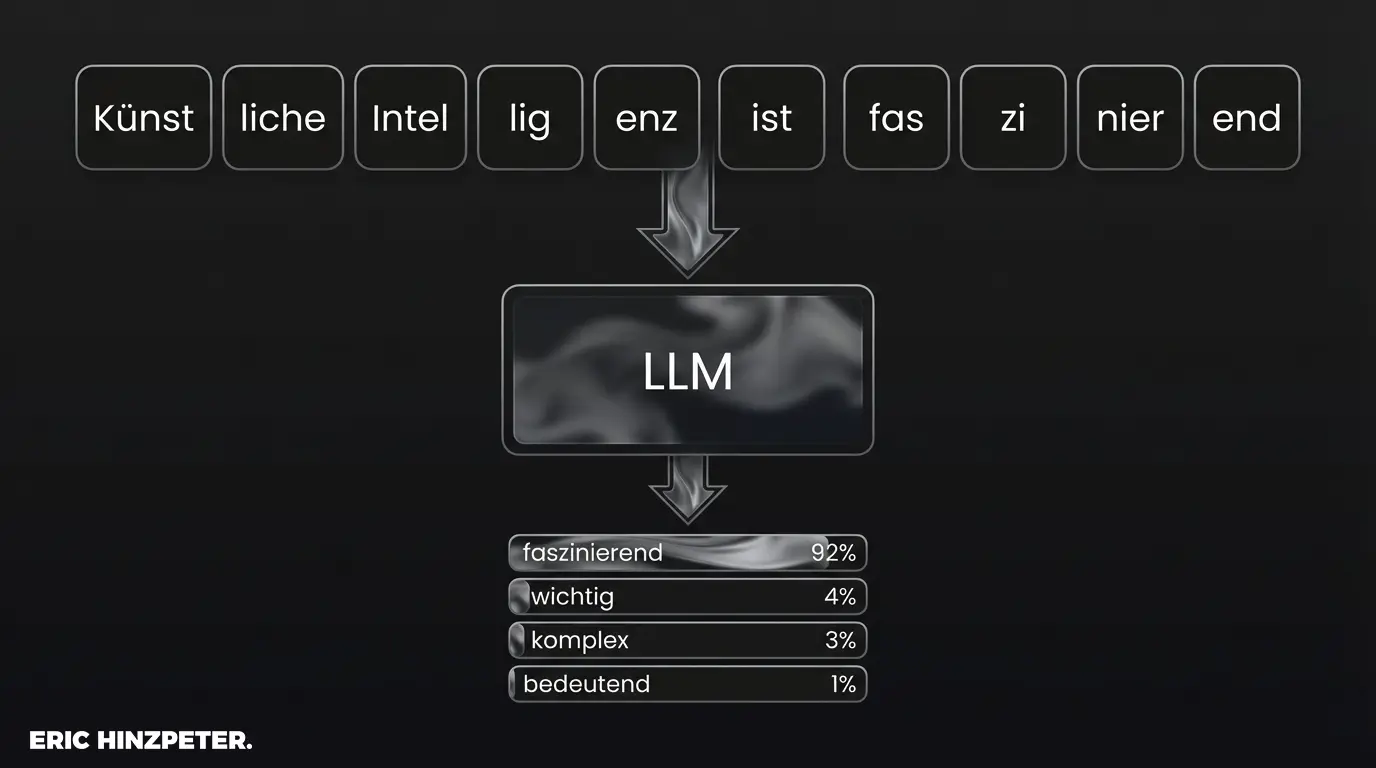

Um effiziente Prompts zu entwickeln, hilft ein Verständnis der zugrundeliegenden Large Language Models (LLMs). Diese Systeme sind im Kern Wahrscheinlichkeitsmaschinen. Sie „wissen“ nichts im menschlichen Sinne, sondern berechnen, welches Wort statistisch gesehen am wahrscheinlichsten auf das vorherige folgt. Ein Prompt ist der Startimpuls, der diese Berechnung in eine definierte Richtung lenkt.

Dabei verarbeiten Sprachmodelle keine ganzen Wörter, sondern zerlegen Text in Tokens. Ein Token kann ein Wort sein, oft aber nur eine Silbe. Das Wort „Hamburg“ besteht für die KI beispielsweise aus den Tokens „Ham“ und „burg“. Diese Mechanik ist entscheidend für die Effizienz: LLMs besitzen ein begrenztes „Kontextfenster“. Je präziser du formulierst, desto mehr relevanter Kontext kann vom System verarbeitet werden.

Natural Language Processing als Basis der Kommunikation

Die Grundlage dieser Interaktion bildet das Natural Language Processing (NLP). Diese Technologie ermöglicht es Maschinen, menschliche Sprache als strukturierten Input zu verarbeiten. Prompt Engineering ist im Grunde angewandtes NLP: Wir nutzen die Mechanismen der Sprachverarbeitung, um die „Next-Token-Prediction“ des Modells gezielt zu manipulieren. Wer die Struktur von Sprache (Syntax, Semantik) versteht, schreibt automatisch bessere Prompts.

Die wichtigsten Prompting-Techniken: Zero-Shot bis Chain-of-Thought

Wer über einfache Spielereien hinaus will, muss methodisch vorgehen. Es gibt etablierte Techniken, die die Antwortqualität von LLMs drastisch verbessern. Die Logik dahinter ist immer gleich: Wir reduzieren den Suchraum der KI, um Halluzinationen zu minimieren und die Präzision zu steigern.

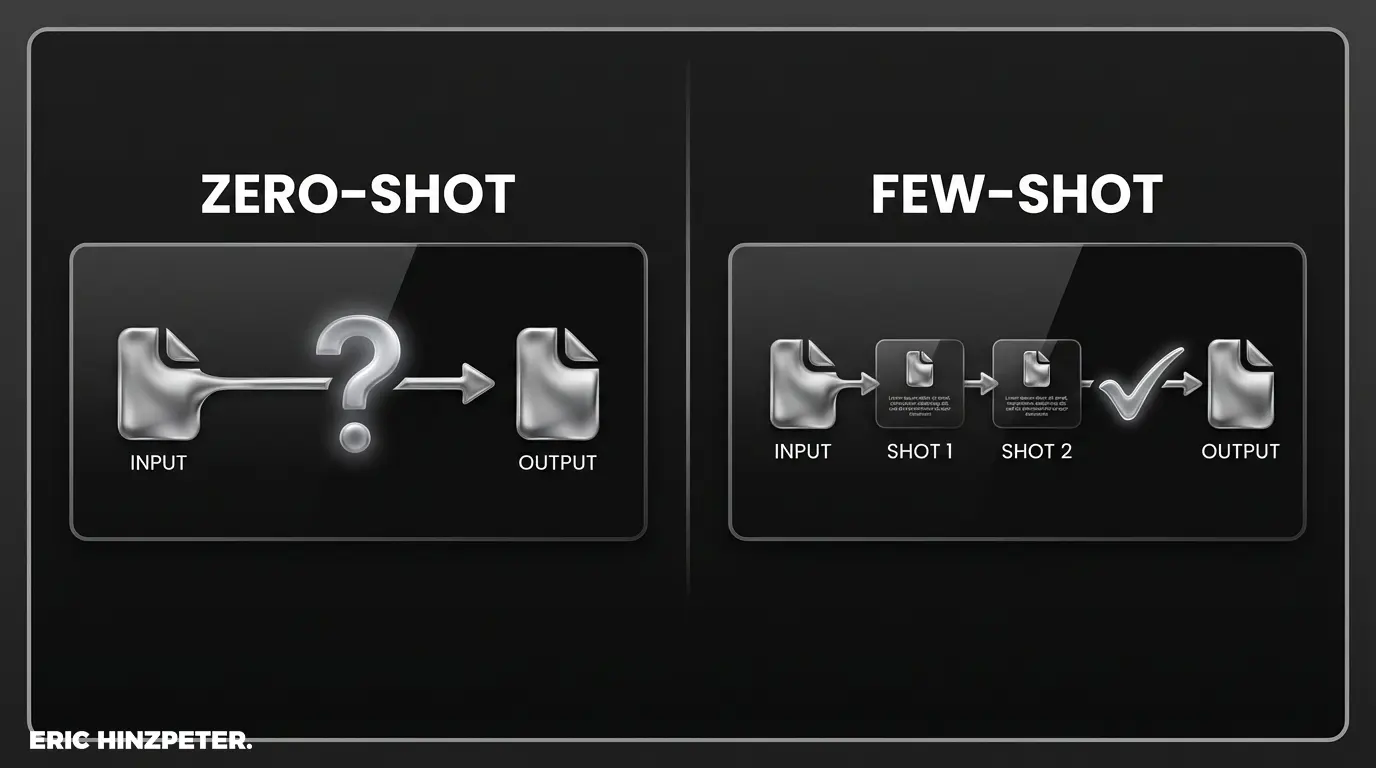

Zero-Shot Prompting vs. Few-Shot Prompting: Der Unterschied erklärt

Die einfachste Form der Interaktion ist das Zero-Shot Prompting. Hier erhält das Modell eine Aufgabe ohne Beispiele.

Beispiel: „Schreibe einen Tweet über SEO.“ Das funktioniert für simple Aufgaben. Bei komplexen Anforderungen stößt diese Methode jedoch an Grenzen, da das Modell den gewünschten Stil oder das Format erraten muss.

Hier zeigt das Few-Shot Prompting seine Stärke. Du gibst dem Modell im Prompt einige Beispiele (Shots) für die gewünschte Lösung mit.

Beispiel: „Hier sind drei Beispiele für erfolgreiche Tweets: [Beispiel 1], [Beispiel 2], [Beispiel 3]. Schreibe basierend auf diesem Stil einen neuen Tweet über SEO.“ Durch die Beispiele lernt das Modell im laufenden Betrieb („In-Context Learning“), Muster zu erkennen und zu replizieren. Die Qualität der Ergebnisse steigt sprunghaft an.

Chain-of-Thought: Komplexe logische Ketten abbilden

Für Aufgaben, die logisches Schlussfolgern erfordern (wie Mathematik oder komplexe Argumentationen), nutzen Profis die Chain-of-Thought (Gedankenkette) Methode. LLMs neigen dazu, bei Rechenaufgaben direkt das Ergebnis zu „raten“ – was oft zu Fehlern führt. Zwingt man das Modell jedoch dazu, seine Zwischenschritte auszugeben, sinkt die Fehlerquote massiv.

Oft reicht dafür der Zusatz: „Denke Schritt für Schritt.“ Das Modell bricht das Problem in Teilprobleme herunter, löst diese nacheinander und kommt so zum korrekten Endergebnis.

Anleitung für den perfekten ChatGPT Prompt

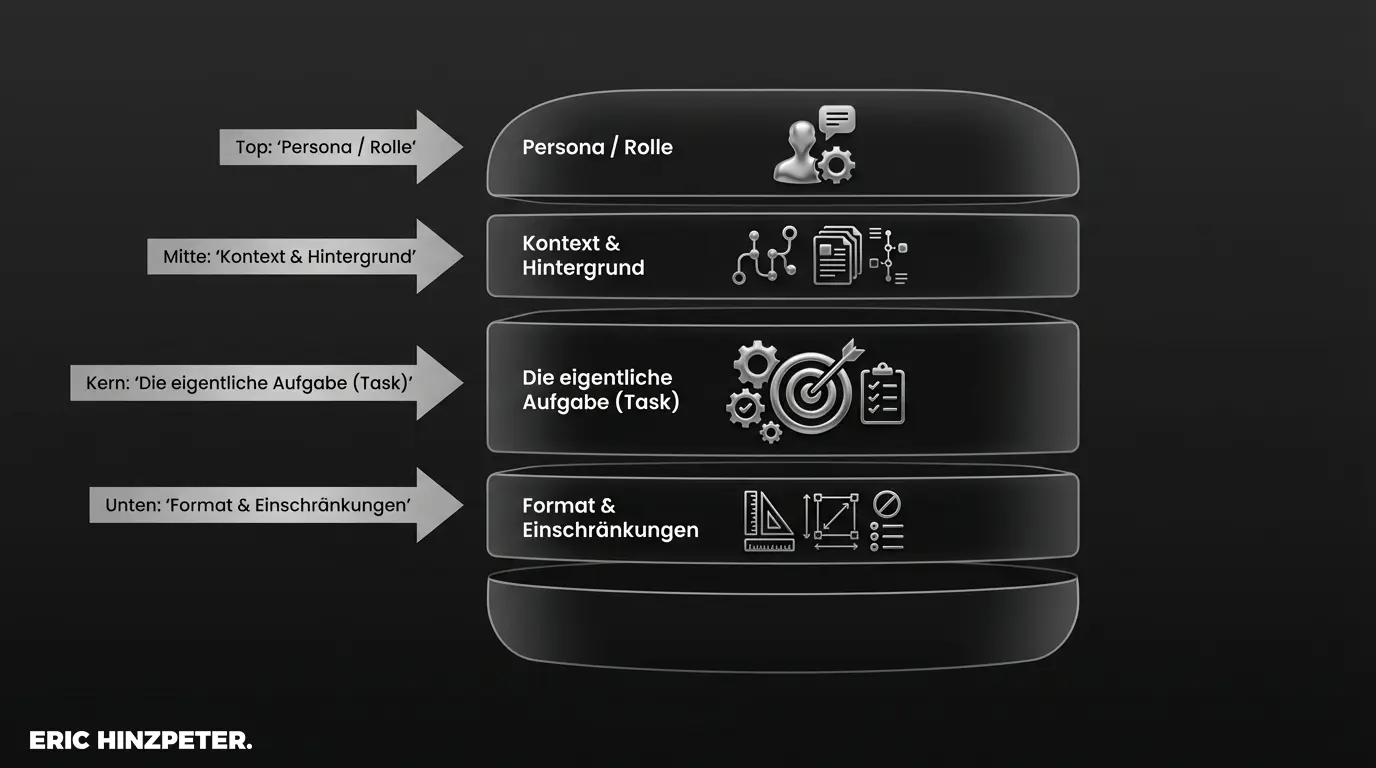

Wie sieht die Architektur eines idealen Prompts für Text-KIs wie ChatGPT aus? Ein systematischer Prompt besteht selten aus einem einzigen Satz. Er gleicht eher einem präzisen Briefing. Für Einsteiger empfiehlt sich ein Blick in unser detailliertes Tutorial für Prompting Grundlagen.

Frameworks für Prompt Design (Kontext, Instruktion, Output-Format)

Ein stabiles Framework für Prompt Design folgt oft der CREATE-Logik. Die elementaren Bausteine einer sauberen Architektur sind:

- Persona: Wer soll die KI sein? (z.B. „Du bist ein erfahrener Steuerberater.“)

- Kontext: Worum geht es? (z.B. „Ich erkläre einem Laien die Einkommensteuer.“)

- Task: Was genau soll getan werden? (z.B. „Erstelle eine Gliederung mit 5 Punkten.“)

- Format: Wie soll das Ergebnis aussehen? (z.B. „Nutze Markdown-Tabellen und Fettungen.“)

- Constraints: Was soll vermieden werden? (z.B. „Benutze kein Fachchinesisch.“)

Rolle von Persona und Stil in GPT-5

Besonders fortschrittliche Modelle wie GPT-5 von OpenAI reagieren extrem sensibel auf die zugewiesene Persona. Wenn du dem Modell die Rolle „akademischer Historiker“ zuweist, ändert sich nicht nur der Wortschatz, sondern auch die Struktur der Argumente. Ohne diese Zuweisung fällt die KI oft in einen generischen, neutralen Tonfall zurück. Die Definition der Persona ist oft der Hebel für Texte, die Authentizität ausstrahlen.

Prompt Engineering für Bildgeneratoren: Midjourney und DALL-E

Während Text-Prompts von Grammatik und Logik leben, funktioniert das Prompting für Bild-KIs wie Midjourney, DALL-E oder Stable Diffusion anders. Hier operieren wir weniger in ganzen Sätzen, sondern mit einer Kombination aus beschreibenden Attributen und technischen Parametern.

Ein Text-zu-Bild Prompt beschreibt das Motiv („Ein Astronaut auf einem Pferd“) und definiert dann den Stil („Ölgemälde“, „Cyberpunk“, „Fotorealistisch“). Entscheidend ist das Vokabular der Kunstgeschichte und Fotografie. Begriffe wie „Bokeh“, „Golden Hour“ oder „ISO 100“ werden von der KI in visuelle Eigenschaften übersetzt. Bei Midjourney kommen technische Parameter (wie `–ar 16:9` für das Seitenverhältnis) hinzu, die in der Midjourney Documentation detailliert nachgelesen werden können.

Anwendungsbeispiele für Prompt Engineering im Unternehmen

Theorie ist gut, aber der Transfer in den Unternehmensalltag entscheidet über den Erfolg. Prompt Engineering ist kein Selbstzweck, sondern ein Werkzeug zur Effizienzsteigerung. Typische Use-Cases sind:

- Marketing: Erstellung von Varianten für Ad-Copy oder SEO-Meta-Beschreibungen in Sekunden.

- Coding: Generierung von Boilerplate-Code oder Unit-Tests durch spezialisierte KI-Tools.

- Kundenservice: Automatisierte Umformulierung von stichpunktartigen Notizen in freundliche E-Mail-Antworten.

Pro-Tipp: Prompt Libraries aufbauen

Es lohnt sich, funktionierende Prompts als digitales Asset zu behandeln. Speichere die besten Strukturen in einer zentralen Datenbank (z.B. Notion). So muss das Rad nicht bei jedem Projekt neu erfunden werden.

Effizienzsteigerung durch Prompt Optimierung

Der erste Prompt ist selten perfekt. Professionelles Arbeiten mit KI bedeutet iteratives Testen, die sogenannte Prompt Optimierung. Man ändert ein Wort, prüft das Ergebnis, passt den Kontext an. Dieser Prozess ähnelt dem A/B-Testing im Marketing.

Häufige Fehler beim Prompt Design vermeiden

Selbst Profis tappen immer wieder in bestimmte Fallen. Ein häufiges Problem ist das mangelnde Kontextverständnis des Nutzers für die Grenzen der KI.

- Vage Anweisungen: „Mach es kürzer“ ist unpräzise. Besser: „Kürze den Text auf maximal 100 Wörter“.

- Überfrachtung: Wer versucht, komplexe Szenarien in einen einzigen Prompt zu packen, wird feststellen, dass das Modell Anweisungen „vergisst“. Zerlege komplexe Aufgaben lieber in eine Kette von Prompts.

- Vertrauen auf Fakten: LLMs sind Sprachkünstler, keine Datenbanken. Sie neigen zu Halluzinationen, wenn sie unter Druck gesetzt werden. Ein Faktencheck bleibt obligatorisch.

Berufsbild Prompt Engineer: Aufgaben und Gehalt

In den Medien wird der „Prompt Engineer“ oft als neuer Traumjob gehandelt. Tatsächlich entwickelt sich hier ein neues Berufsbild, wobei die Fähigkeiten oft auch als Zusatzqualifikation in bestehenden Berufen gefragt sind.

Zu den Aufgaben gehört nicht nur das Schreiben von Prompts, sondern auch der Aufbau von Test-Pipelines, die Bewertung von Modell-Outputs und die Schulung von Teams. Das Gehalt variiert stark: Während in den USA teils hohe Summen aufgerufen werden, pendeln sich spezialisierte Rollen in Deutschland oft zwischen 60.000 € und 90.000 € ein, stark abhängig von der technischen Tiefe der Rolle.

Die Zukunft der Interaktion mit Künstlicher Intelligenz

Wird Prompt Engineering ein dauerhafter Beruf bleiben? Mit steigender Intelligenz der Systeme werden diese unsere Intentionen besser antizipieren können, was komplexes „Engineering“ teilweise vereinfacht. Zudem sehen wir einen Trend zum „Auto-Prompting“, bei dem eine KI die Prompts für eine andere KI optimiert.

Sicher ist jedoch: Das Verständnis dafür, wie man präzise mit Maschinen kommuniziert, bleibt eine Schlüsselkompetenz – unabhängig davon, ob wir tippen, sprechen oder über multimodale Schnittstellen interagieren.