Was ist Retrieval Augmented Generation (RAG)?

Alle reden darüber, wie eloquent ChatGPT und Co. mittlerweile sind. Was dabei gerne unter den Tisch fällt: Das Modell hat keine Ahnung von deinem Business. Es kennt weder deine aktuelle Preisliste noch deine internen Support-Richtlinien. Retrieval Augmented Generation, kurz RAG, ist die architektonische Antwort auf genau dieses Wissensproblem.

RAG ist eine Methode, die einer Generativen KI erlaubt, in externen Quellen zu spicken, bevor sie antwortet. Der Unterschied ist fundamental:

- Ohne RAG (Standard LLM): Das Modell muss alles auswendig wissen. Was es nicht weiß, erfindet es oft einfach dazu.

- Mit RAG: Das Modell darf wie ein Bibliothekar im Fachbuch nachschlagen – in deinen Unternehmensdaten. Es liest die Seite und gibt die Fakten wieder.

Das Ergebnis: eine KI, die faktisch korrekte Antworten liefert – auf Basis deines Wissens, ohne teures Neutraining.

Pro-Tipp: Prompting statt Training

Viele Einsteiger tappen in die Falle und wollen die KI mit Daten „füttern“ (trainieren). Bei RAG passiert das Gegenteil: Die Daten bleiben in deiner Datenbank. Wir geben der KI per Prompt nur temporär den passenden Textauszug zum Lesen. Das spart Rechenkosten und hält die Daten sauber getrennt.

Kernkonzept: Warum LLMs externe Daten brauchen

Jedes Large Language Model hat ein Verfallsdatum, den sogenannten „Knowledge Cutoff“. Alles, was nach dem Training passiert ist, existiert für die KI schlicht nicht. Dazu kommt: LLMs sind probabilistisch. Sie berechnen Wahrscheinlichkeiten für das nächste Wort, sie prüfen keine Fakten.

Das führt zu Halluzinationen: Die KI erzählt kompletten Unsinn, aber mit einem Selbstbewusstsein, das jeden Vertriebler neidisch machen würde. Wenn wir RAG einsetzen, zwingen wir das Modell, seine „Kreativität“ auf die Fakten zu beschränken, die wir ihm liefern. RAG ist die Lesebrille, durch die das LLM auf deine proprietären Daten schaut.

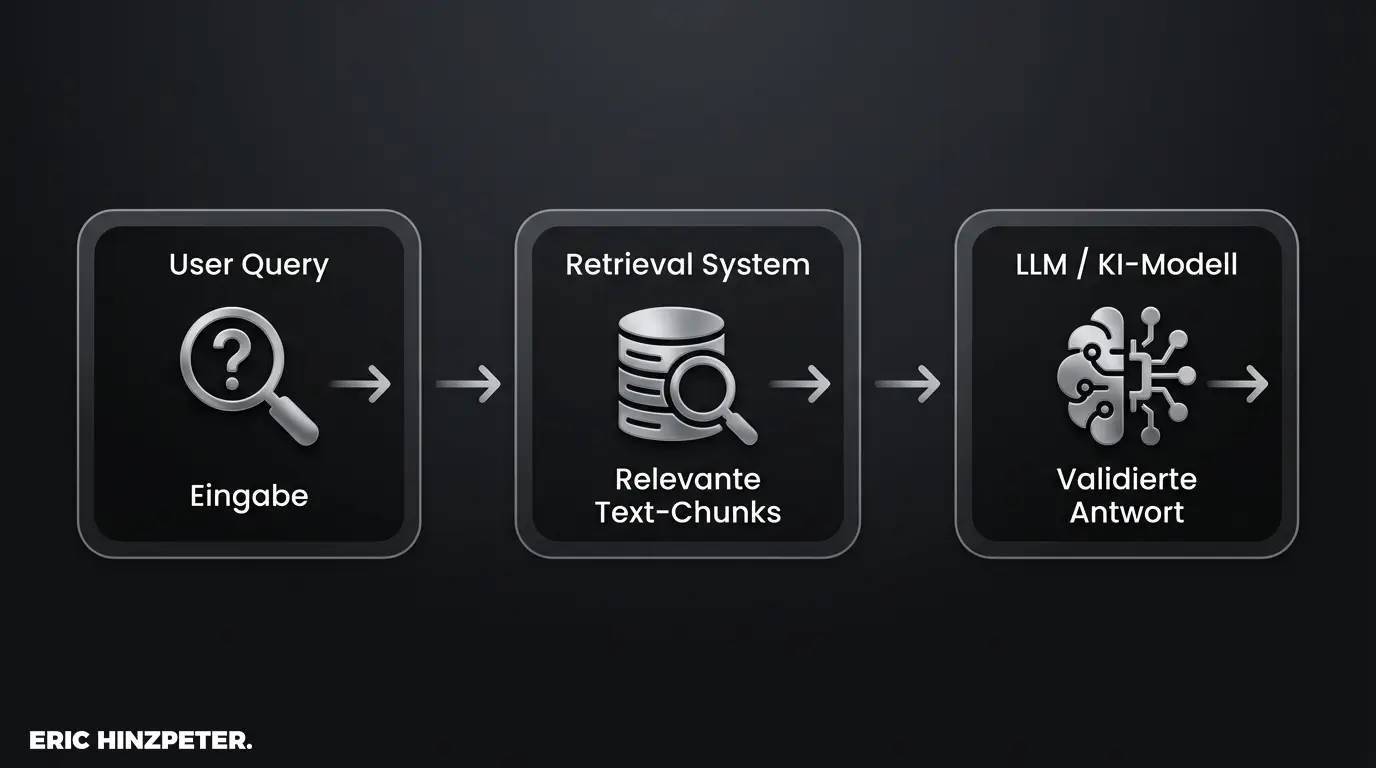

Wie funktioniert die RAG-Architektur?

Die Logik ist einfacher als sie klingt – drei Schritte, ein Ziel: Die Frage des Nutzers mit Wissen anreichern, bevor die KI antwortet.

- Frage (Query): Der Nutzer fragt: „Wie sind die aktuellen Lieferbedingungen für Produkt X?“

- Suche (Retrieval): Das System sucht im Hintergrund in deinen Dokumenten nach dem Absatz, der genau das erklärt.

- Antwort (Generation): Das System nimmt die gefundene Textstelle, klebt sie an die Frage und sagt der KI: „Nutze diese Infos für die Antwort.“

Der kritische Punkt ist das Retrieval. Findet das System die falsche Textstelle, wird auch die Antwort falsch sein. Die Qualität der Suche entscheidet über den Erfolg.

Die RAG-Pipeline: Ingestion, Retrieval & Generation

Damit der Computer deine PDF-Handbücher durchsuchen kann, müssen sie durch eine sogenannte RAG-Pipeline – technisch klingt das sperriger als es ist.

Zuerst das Chunking. Eine KI sollte kein ganzes Buch auf einmal lesen – das System zerhackt deine Dokumente deshalb in kleine Häppchen, die Chunks. Wir schneiden quasi die relevanten Zeitungsartikel für das Archiv aus.

Dann die Vektorisierung. Computer verstehen keine Wörter, sie verstehen Zahlen. Ein Algorithmus wandelt den Text in Zahlenreihen um, die die Bedeutung repräsentieren. Das ermöglicht die Semantische Suche: Das System findet nicht nur „Auto“, sondern auch „PKW“, weil die Zahlenwerte ähnlich sind.

Die Rolle von Vektordatenbanken und Embeddings

Wo lagern diese tausenden Text-Schnipsel? In einer Vektordatenbank – stell dir das wie einen gigantischen, mehrdimensionalen Aktenschrank vor.

Die Zahlenreihen nennen wir Embeddings. Sie sind die Koordinaten im Schrank. Wenn ein Nutzer fragt, wird auch die Frage in Koordinaten umgerechnet. Das System schaut dann: Welche Dokumente liegen räumlich nah an der Frage? Was nah beieinander liegt, gehört thematisch zusammen. Ohne Vektordatenbank wäre RAG nur eine simple Stichwortsuche – und damit meistens nutzlos.

Pro-Tipp: Datenqualität vor Tool-Auswahl

Bevor du teure Lizenzen kaufst: Prüfe deine Daten. Wenn im PDF Unsinn steht, liefert auch die beste RAG-Architektur Unsinn („Garbage In, Garbage Out“). Strukturiere deine Dokumente, bevor du sie vektorisierst.

RAG vs. Fine-Tuning: Ein Vergleich

Hier verbrennen Unternehmen gerne Budget. „Müssen wir das Modell nicht auf unsere Daten trainieren?“ Kurze Antwort: Meistens nein.

Fine-Tuning ist wie das Lernen für eine Prüfung. Du bringst dem Modell Wissen dauerhaft bei, indem du das Gehirn der KI veränderst. Das ist teuer, langsam – und das Wissen ist sofort veraltet, wenn sich deine Daten ändern. Es eignet sich, um einen Stil zu lernen (z.B. „Sprich wie ein Arzt“), aber schlecht für Fakten.

RAG ist der Spickzettel. Das Modell bleibt dumm, was deine Daten angeht – weiß aber, wo der Zettel liegt. Ändert sich der Preis, tauschst du einfach den Zettel aus. Kein Neutraining nötig.

RAG Trends 2026: GraphRAG und Agentic RAG

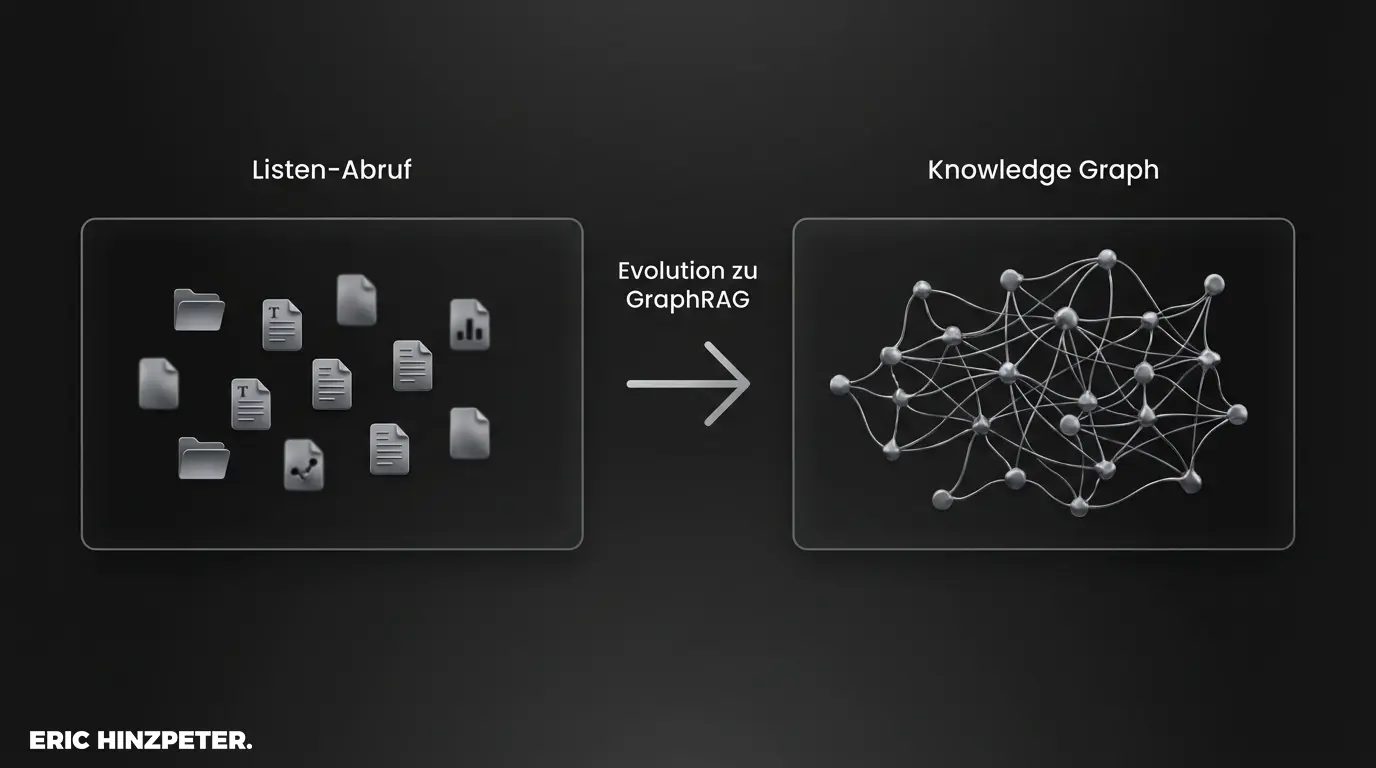

Einfaches RAG ist heute Standard. 2026 zeichnen sich zwei Entwicklungen ab, die das Grundprinzip erweitern.

Die erste ist GraphRAG. Normales RAG sucht Listen von Dokumenten. GraphRAG versteht Verbindungen. Fragst du: „Welche Auswirkung hat Teil A auf Projekt B?“, sieht GraphRAG die Verbindung über einen Wissensgraphen. Es erkennt Zusammenhänge zwischen Entitäten – nicht nur passende Schlagworte.

Gleichzeitig wächst das Kontextfenster moderner Modelle – sie lesen ganze Romane auf einmal. Aber das ist oft teuer und langsam. RAG bleibt die effizientere Methode für große Wissensdatenbanken.

Vom statischen Abruf zum autonomen Agenten

Die zweite Entwicklung ist Agentic RAG. Bisher war RAG passiv: Frage rein, Antwort raus. Künftig agieren autonome Agenten.

Ein Agent merkt selbst: „Die Info reicht nicht.“ Er entscheidet autonom, weiterzusuchen oder nachzufragen. Aus dem Suchschlitz wird ein digitaler Mitarbeiter, der recherchiert, bis die Antwort passt.

Vorteile von RAG für Unternehmen

Drei Argumente, die für Entscheider zählen:

- Datenschutz. Deine sensiblen Daten müssen nicht zu einem US-Anbieter wandern. Sie bleiben in deiner Datenbank und werden nur im Moment der Anfrage kurz verarbeitet.

- Aktualität. Du kannst kein KI-Modell jede Woche neu trainieren. Bei RAG lädst du das neue PDF hoch, fertig. Der Chatbot nutzt sofort die neuen Infos.

- Transparenz. Eine Generative KI ist oft eine Blackbox. RAG kann sagen: „Ich habe das aus Dokument X, Seite 12.“ Das schafft Vertrauen und Nachvollziehbarkeit.

RAG ist kein Trend – es ist Infrastruktur

Retrieval Augmented Generation ist aktuell der zuverlässigste Ansatz, um KI im Unternehmen produktiv zu machen. Es löst das Halluzinations-Problem nicht zu 100 %, drückt das Risiko aber auf ein Minimum. Wer eigenes Wissen und Modell-Intelligenz verbinden will, braucht genau das: eine Brücke zwischen den Daten und der KI – und RAG baut sie.